Linia regresji metodą najmniejszych kwadratów

Natychmiast oblicz linię regresji metodą najmniejszych kwadratów. Wprowadź swoje dane, aby znaleźć najlepiej dopasowane równanie liniowe OLS y = mx + b z...

Linia regresji metodą najmniejszych kwadratów

Natychmiast oblicz linię regresji metodą najmniejszych kwadratów. Wprowadź swoje dane, aby znaleźć najlepiej dopasowane równanie liniowe OLS y = mx + b z...

Wprowadź swoje punkty danych

| # | X | Y |

|---|

Results

Równanie regresji

Nachylenie (m)

Punkt przecięcia Y (b)

R² (współczynnik determinacji)

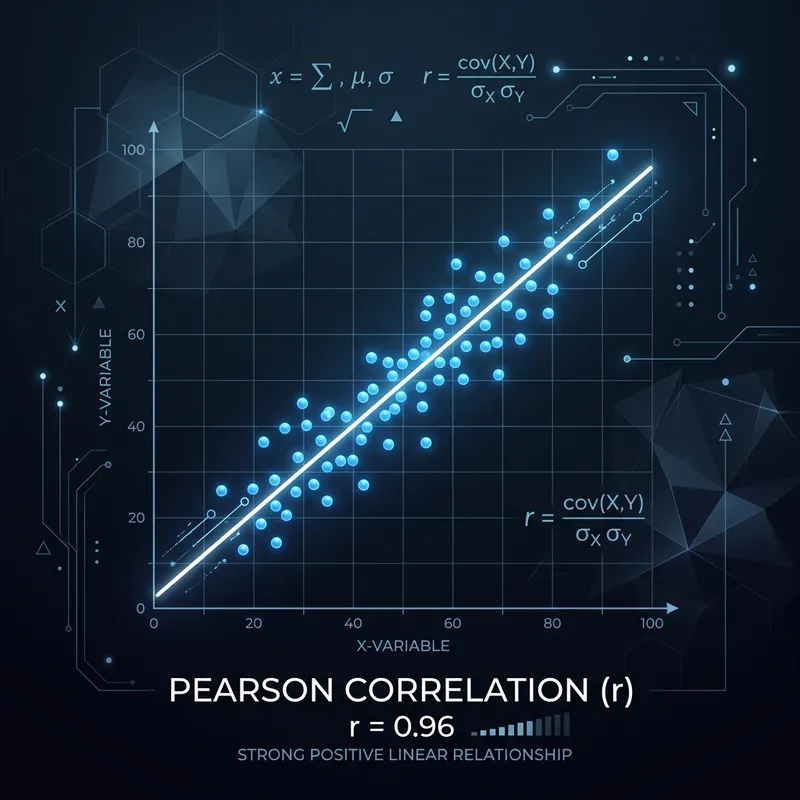

Correlation (r)

Przewidywany Y

Intermediate Calculations

| Symbol | Natychmiast oblicz linię regresji metodą najmniejszych kwadratów. Wprowadź swoje dane, aby znaleźć najlepiej dopasowane równanie liniowe OLS y = mx + b z... | Value |

|---|

Statistics

| Statistic | Value |

|---|---|

| Standard Error | |

| Sample Size (n) | |

| Degrees of Freedom |

Chart

Rozwiązanie krok po kroku

Jak tego używać Linia regresji metodą najmniejszych kwadratów

Best Fit Line

Find the unique line that minimizes the total distance from all data points.

Wyniki statystyczne

Get the full equation y = a + bx, slope, intercept, and R-squared metrics.

Residual Analysis

Understand the deviation between observed values and model predictions.

The least squares method is the gold standard for linear regression in most scientific fields.

Co to jest linia regresji metodą najmniejszych kwadratów?

📊 Linia regresji metodą najmniejszych kwadratów (LSRL) to linia prosta, która minimalizuje sumę kwadratów odległości pionowych między obserwowanymi punktami danych a linią. Matematycznie, jeśli mamy n punktów danych (x₁, y₁), (x₂, y₂), …, (xₙ, yₙ), LSRL jest linią ŷ = mx + b, która minimalizuje wielkość Σ(yᵢ − ŷᵢ)², gdzie ŷᵢ = mxᵢ + b to przewidywana wartości.

🏆 To kryterium nazywa się kryterium najmniejszych kwadratów, a otrzymana linia jest również nazywana linią zwykłych najmniejszych kwadratów (OLS) lub linią najlepszego dopasowania. Metoda najmniejszych kwadratów ma bogatą historię sięgającą Adriena-Marie Legendre'a w 1805 r., który opublikował ją jako metodę wyznaczania orbit komet, oraz Carla Friedricha Gaussa, który twierdził, że stosuje ją od 1795 r., a później rozwinął ją dalej w swojej teorii błędów.

⚠️ Nazwa „najmniejsze kwadraty” pochodzi bezpośrednio od celu matematycznego: spośród wszystkich możliwych linii, wybieramy tę, która sprawia, że suma kwadratów reszt jest jak najmniejsza — najmniejszą sumę kwadratów. Podniesienie reszt do kwadratu (zamiast przyjmowania wartości bezwzględnych) gwarantuje, że błędy dodatnie i ujemne nie znoszą się wzajemnie, a także nadaje większą wagę większym odchyleniom, co jest statystycznie pożądane.

📊 Obecnie linia regresji metodą najmniejszych kwadratów jest najczęściej stosowaną metodą dopasowywania linii prostej przez punkty danych w statystyce, ekonomii, naukach przyrodniczych, społecznych i inżynierii. Służy jako podstawa dla bardziej zaawansowanych technik, w tym regresji wielokrotnej, uogólnionych modeli liniowych i algorytmów uczenia maszynowego. Każdy kurs wprowadzający do statystyki uczy LSRL jako kamienia węgielnego analizy regresji.

Metoda najmniejszych kwadratów

- 1 Oblicza linię minimalizującą sumę kwadratów reszt

- 2 Używa równań normalnych: Σ(y) = nb + mΣ(x) i Σ(xy) = bΣ(x) + mΣ(x²)

- 3 Rozwiązuje nachylenie m = SSxy / SSxx i punkt przecięcia b = ȳ - m·x̄

- 4 Podaje R², błąd standardowy i wszystkie sumy pośrednie

Kiedy stosować regresję metodą najmniejszych kwadratów

- Liniowa analiza trendów w biznesie i ekonomii

- Kontrola jakości i monitorowanie procesów

- Krzywe kalibracyjne w warunkach laboratoryjnych

- Nauczanie edukacyjne z zakresu statystyki podstawowej

- Każda sytuacja wymagająca najlepiej dopasowanej linii prostej

Założenia regresji metodą najmniejszych kwadratów

- 1. Liniowość: zależność pomiędzy X i Y musi być liniowa. Sprawdź za pomocą wykresu punktowego Y w funkcji X oraz wykresu reszt w funkcji wartości przewidywanych. Zakrzywiony wzór na każdym wykresie wskazuje na nieliniowość.

- 2. Niezależność: Reszty muszą być niezależne — bez autokorelacji. Sprawdź testem Durbina-Watsona (d ≈ 2 oznacza brak autokorelacji). Dane szeregów czasowych często naruszają to założenie.

- 3. Homoscedastyczność: wariancja resztkowa musi być stała dla wszystkich przewidywanych wartości. Sprawdź za pomocą wykresu reszt (rozrzut powinien być mniej więcej równy) lub testu Breuscha-Pagana. Kształt lejka wskazuje na heteroskedastyczność.

- 4. Normalność: reszty powinny mieć w przybliżeniu rozkład normalny. Sprawdź za pomocą histogramu, normalnego wykresu prawdopodobieństwa (wykres Q-Q) lub testu Jarque-Bera. Duże próby (n> 30) są bardziej odporne na naruszenia.

- 5. Brak wpływowych wartości odstających: pojedyncza skrajna wartość odstająca może radykalnie przesunąć linię regresji. Sprawdź, korzystając z odległości Cooka lub wartości dźwigni. Jeśli nie można usunąć wartości odstających, należy rozważyć solidną regresję.

- 6. Reprezentatywna próbka: dane powinny stanowić reprezentatywną próbę danej populacji. Wygodne próbki lub obcięte zakresy mogą dawać mylące wyniki regresji.