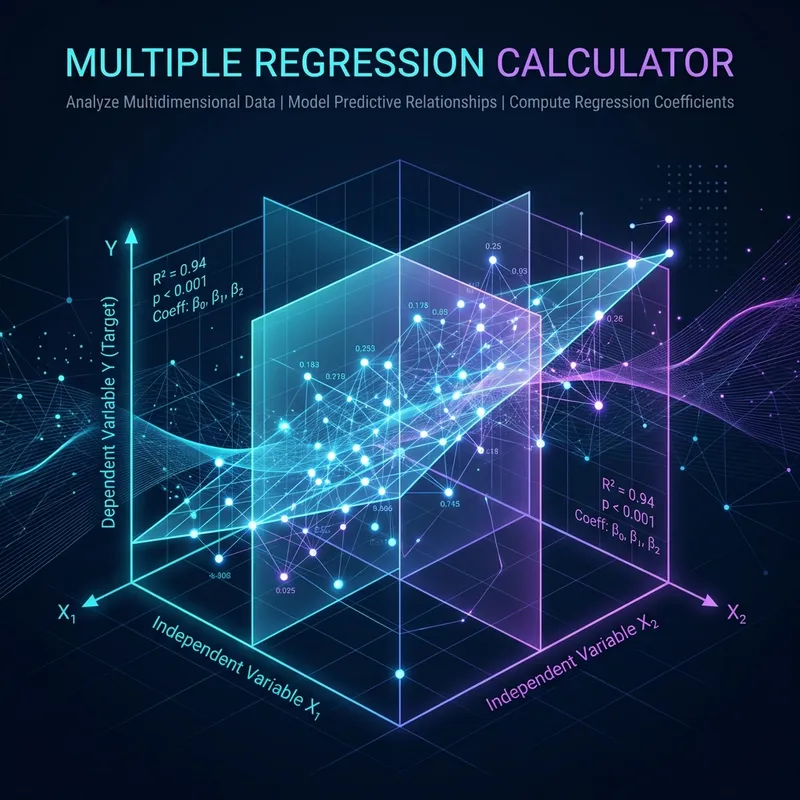

Kalkulator regresji wielokrotnej

Oblicz równania regresji wielokrotnej z dwoma lub większą liczbą predyktorów. Znajdź najlepszy model dla swoich danych, korzystając z naszego bezpłatnego...

Kalkulator regresji wielokrotnej

Oblicz równania regresji wielokrotnej z dwoma lub większą liczbą predyktorów. Znajdź najlepszy model dla swoich danych, korzystając z naszego bezpłatnego...

Wprowadź swoje punkty danych

Wyniki

R-kwadrat

Adjusted R-Squared

Standard Error

Rozwiązanie krok po kroku

Jak tego używać Kalkulator regresji wielokrotnej

Complex Modeling

Analyze how multiple factors simultaneously influence your dependent variable.

Wyniki statystyczne

Calculate partial coefficients, standard errors, and adjusted R-squared values.

Diagnostics

Built-in checks for multicollinearity and model significance.

Multiple regression helps isolate the effect of one variable while controlling for others.

Jak obliczyć regresję wielokrotną

📐 Regresja wielokrotna rozszerza prostą regresję liniową na dwie lub więcej zmiennych predykcyjnych, tworząc równanie y = b₀ + b₁x₁ + b₂x₂ + … + bₚxₚ, gdzie każdy współczynnik bᵢ reprezentuje wpływ predyktora xᵢ na y przy jednoczesnym zachowaniu wszystkich pozostałych predyktorów stała.

❌ Ta właściwość „utrzymywania stałej” sprawia, że regresja wielokrotna jest tak potężna — pozwala wyizolować unikalny wkład każdego predyktora, kontrolując czynniki zakłócające, które w przeciwnym razie zniekształciłyby wyniki. Na przykład, jeśli chcesz zbadać wpływ wykształcenia na dochody, zwykła regresja dochodu na wykształcenie połączyłaby wpływ edukacji z wpływem doświadczenia, ponieważ lepiej wykształceni ludzie również mają zwykle więcej doświadczenia.

📐 Regresja wielokrotna rozwiązuje ten problem, uwzględniając zarówno wykształcenie, jak i doświadczenie jako predyktory, więc każdy współczynnik odzwierciedla rzeczywisty wpływ samej tej zmiennej. Regresja wielokrotna to najpowszechniej stosowana technika regresji w badaniach, analityce biznesowej, naukach społecznych, medycynie i uczeniu maszynowym, ponieważ wyniki w świecie rzeczywistym prawie zawsze zależą od wielu czynników jednocześnie.

📊 Model z jednym predyktorem rzadko oddaje wystarczającą zmienność, aby był użyteczny — dodanie odpowiednich predyktorów prawie zawsze zwiększa moc wyjaśniającą i poprawia dokładność przewidywań. Do najważniejszych zgłaszanych statystyk należą R² (proporcja wariancji wyjaśniona przez wszystkie predyktory razem), skorygowany R² (który penalizuje dodanie predyktorów, które faktycznie nie poprawiają modelu), statystykę F (która sprawdza, czy cały model jest statystycznie istotny) oraz błąd standardowy oszacowania (który mierzy średnią odległość punktów danych od hiperpłaszczyzny regresji).

📊 Zrozumienie tych metryk jest niezbędne do budowania wiarygodnych modeli i unikanie nadmiernego dopasowania, które ma miejsce, gdy uwzględni się zbyt wiele predyktorów w stosunku do wielkości próby.