Minsta kvadraters regressionslinje

Beräkna minsta kvadraters regressionslinje direkt. Ange dina data för att hitta OLS bästa linjeekvation y = mx + b med omfattande matematiska lösningar.

Minsta kvadraters regressionslinje

Beräkna minsta kvadraters regressionslinje direkt. Ange dina data för att hitta OLS bästa linjeekvation y = mx + b med omfattande matematiska lösningar.

Ange dina datapunkter

| # | X | Y |

|---|

Results

Regressionsekvation

Lutning (m)

Y-intercept (b)

R² (bestämningskoefficient)

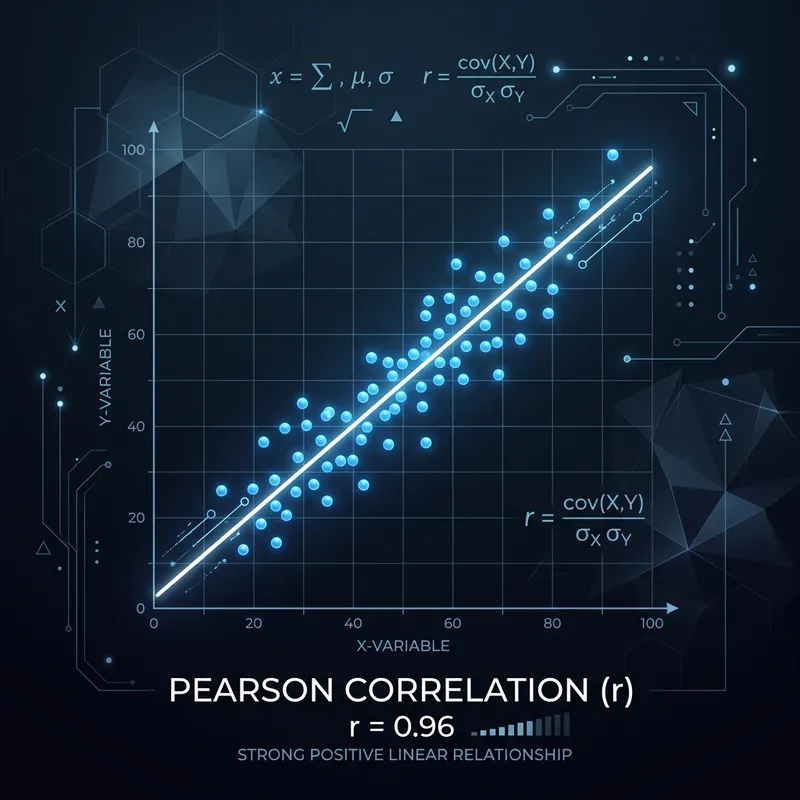

Correlation (r)

Förutspådde Y

Intermediate Calculations

| Symbol | Beräkna minsta kvadraters regressionslinje direkt. Ange dina data för att hitta OLS bästa linjeekvation y = mx + b med omfattande matematiska lösningar. | Value |

|---|

Statistics

| Statistic | Value |

|---|---|

| Standard Error | |

| Sample Size (n) | |

| Degrees of Freedom |

Chart

Steg-för-steg lösning

Hur man använder detta Minsta kvadraters regressionslinje

Best Fit Line

Find the unique line that minimizes the total distance from all data points.

Statistisk utdata

Get the full equation y = a + bx, slope, intercept, and R-squared metrics.

Residual Analysis

Understand the deviation between observed values and model predictions.

The least squares method is the gold standard for linear regression in most scientific fields.

Vad är minsta kvadraters regressionslinje?

📊 Minsta kvadraters regressionslinje (LSRL) är den räta linjen som minimerar summan av de kvadratiska vertikala avstånden mellan observerade datapunkter och linjen. Matematiskt, om vi har n datapunkter (x₁, y₁), (x₂, y₂), …, (xₙ, yₙ), är LSRL linjen ŷ = mx + b som minimerar kvantiteten Σ(yᵢ) = ŷᵢ − ²ŷx> där + b är de förutsagda värdena.

🏆 Detta kriterium kallas minsta kvadratkriteriet, och den resulterande linjen är också känd som OLS-linjen (Ordinary Least Squares) eller linjen med bästa passform. Metoden med minsta kvadrater har en rik historia som går tillbaka till Adrien-Marie Legendre 1805, som publicerade den som ett sätt att bestämma kometernas banor, och Carl Friedrich Gauss, som hävdade att han hade använt den sedan 1795 och senare utvecklade den vidare i sin teori om namnen "⚠️ts kvadraten kommer direkt från felen.

📊 Idag är minsta kvadraters regressionslinje den mest använda metoden för att passa en rak linje genom datapunkter inom statistik, ekonomi, samhällsvetenskap, samhällsvetenskap. Det fungerar som grunden för mer avancerade tekniker inklusive multipel regression, generaliserade linjära modeller och maskininlärningsalgoritmer. Varje inledande statistikkurs lär ut LSRL som hörnstenen i regressionsanalys.

Minsta kvadratmetoden

- 1 Beräknar linjen som minimerar summan av kvadrerade residualer

- 2 Använder normalekvationerna: Σ(y) = nb + mΣ(x) och Σ(xy) = bΣ(x) + mΣ(x²)

- 3 Löser för lutning m = SSxy / SSxx och skärningspunkt b = ȳ - m·x̄

- 4 Ger R², standardfel och alla mellansummor

När ska man använda minsta kvadraters regression

- Linjär trendanalys inom företag och ekonomi

- Kvalitetskontroll och processövervakning

- Kalibreringskurvor i laboratoriemiljöer

- Pedagogisk undervisning i grundläggande statistik

- Alla situationer som kräver den raka linjen som passar bäst

Antaganden om minsta kvadraters regression

- 1. Linjäritet: Relationen mellan X och Y måste vara linjär. Kontrollera med ett spridningsdiagram av Y vs. X och ett restdiagram av residualer vs. förutsagda värden. Ett krökt mönster i båda diagrammet indikerar icke-linjäritet.

- 2. Oberoende: Residualer måste vara oberoende – ingen autokorrelation. Kontrollera med Durbin-Watson-testet (d ≈ 2 betyder ingen autokorrelation). Tidsseriedata bryter ofta mot detta antagande.

- 3. Homoskedasticitet: Kvarvarande varians måste vara konstant över alla förutsagda värden. Kontrollera med en restplot (spridningen bör vara ungefär lika stor) eller Breusch-Pagan-testet. En trattform indikerar heteroskedasticitet.

- 4. Normalitet: Rester bör vara ungefär normalfördelade. Kontrollera med ett histogram, normal sannolikhetsplot (Q-Q plot) eller Jarque-Bera-testet. Stora urval (n> 30) är mer robusta mot överträdelser.

- 5. Inga inflytelserika extremvärden: En enda extrem extremvärde kan dramatiskt förskjuta regressionslinjen. Kontrollera med Cooks avstånd eller hävstångsvärden. Överväg robust regression om extremvärden inte kan tas bort.

- 6. Representativt urval: Uppgifterna bör vara ett representativt urval av populationen av intresse. Bekvämlighetsprover eller trunkerade intervall kan ge missvisande regressionsresultat.