Kalkylator för multipel regression

Beräkna multipla regressionsekvationer med två eller flera prediktorer. Hitta den bästa modellen för dina data med hjälp av vårt kostnadsfria statistiska...

Kalkylator för multipel regression

Beräkna multipla regressionsekvationer med två eller flera prediktorer. Hitta den bästa modellen för dina data med hjälp av vårt kostnadsfria statistiska...

Ange dina datapunkter

Resultat

R-kvadrat

Adjusted R-Squared

Standard Error

Steg-för-steg lösning

Hur man använder detta Kalkylator för multipel regression

Complex Modeling

Analyze how multiple factors simultaneously influence your dependent variable.

Statistisk utdata

Calculate partial coefficients, standard errors, and adjusted R-squared values.

Diagnostics

Built-in checks for multicollinearity and model significance.

Multiple regression helps isolate the effect of one variable while controlling for others.

Hur man beräknar multipel regression

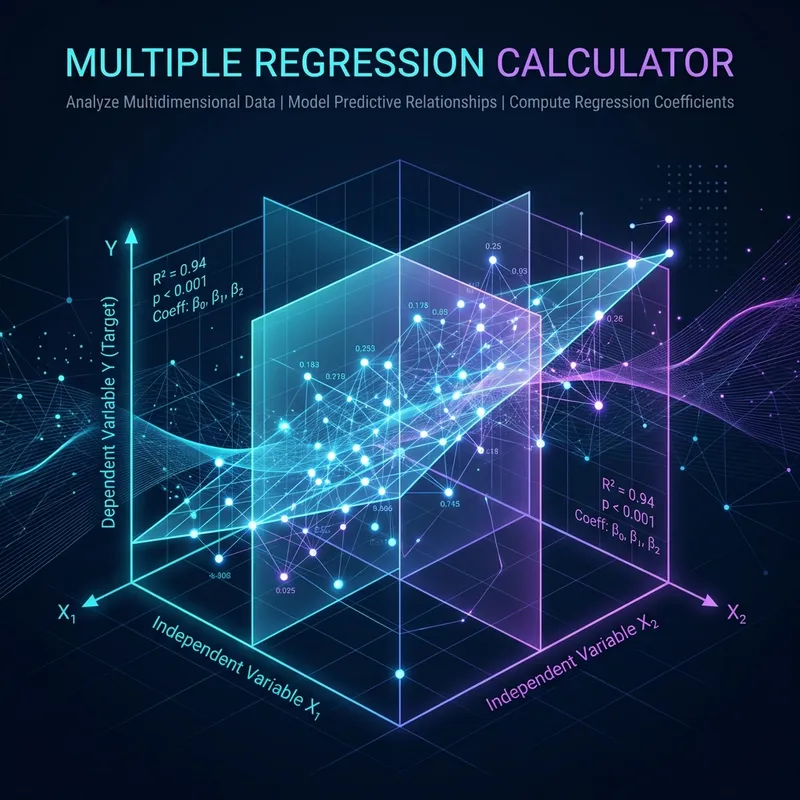

📐 Multipel regression utvidgar enkel linjär regression till två eller flera prediktorvariabler, vilket ger ekvationen y = b₀ + b₁x₁ + b₂x₂ + … + bₚxₚ, där varje koefficient effekt av förutsägelse av ᵢ representerar

❌ Den här egenskapen "håller konstant" är det som gör multipel regression så kraftfull – den låter dig isolera det unika bidraget från varje prediktor och kontrollera för konfounders som annars skulle förvränga dina resultat. Om du till exempel vill studera effekten av utbildning på inkomst, skulle en regressering av inkomst på utbildning förena effekten av utbildning med effekten av erfarenhet, eftersom mer utbildade människor också tenderar att ha mer erfarenhet.

📐 Multipel regression löser detta genom att inkludera både utbildning och erfarenhet som prediktorer, så varje koefficient återspeglar den verkliga effekten av den variabeln ensam. Multipel regression är den mest använda regressionstekniken inom forskning, affärsanalys, samhällsvetenskap, medicin och maskininlärning eftersom verkliga utfall nästan alltid beror på flera faktorer samtidigt.

📊 En enkelprediktormodell fångar sällan tillräckligt mycket av variationen för att vara användbar – att lägga till relevanta prediktorer ökar nästan alltid förklaringsförmågan och förbättrar förklaringskraften. Den rapporterade nyckelstatistiken inkluderar R² (andelen av varians som förklaras av alla prediktorer tillsammans), justerad R² (vilket straffar för att lägga till prediktorer som inte verkligen förbättrar modellen), F-statistiken (som testar om den övergripande modellen är statistiskt signifikant) och standardfelet för uppskattningen av uppskattningen (vilket mäter den genomsnittliga dataavståndet som mäter den hyperplane).

📊 Det är viktigt att förstå dessa mätvärden för att bygga tillförlitliga modeller och undvika överanpassning, vilket inträffar när för många prediktorer inkluderas i förhållande till urvalsstorleken.