Линия на регресия на най-малките квадрати

Незабавно изчислете регресионната линия на най-малките квадрати. Въведете вашите данни, за да намерите OLS най-подходящото линейно уравнение y = mx + b с...

Линия на регресия на най-малките квадрати

Незабавно изчислете регресионната линия на най-малките квадрати. Въведете вашите данни, за да намерите OLS най-подходящото линейно уравнение y = mx + b с...

Въведете вашите данни

| # | X | Y |

|---|

Results

Регресионно уравнение

Наклон (m)

Y-отсечка (b)

R² (коефициент на определяне)

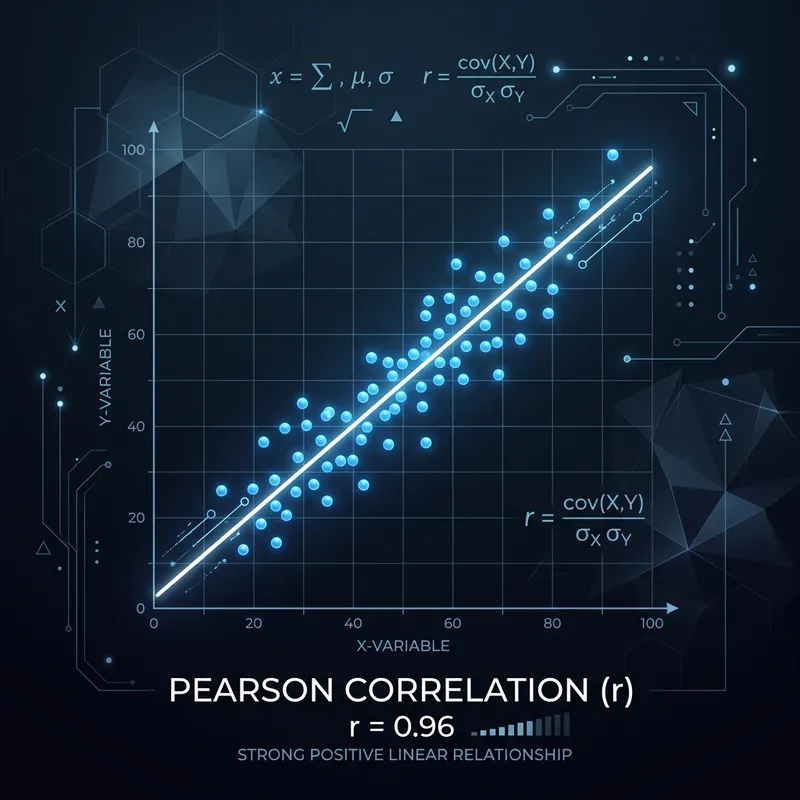

Correlation (r)

Предсказаният Y

Intermediate Calculations

| Symbol | Незабавно изчислете регресионната линия на най-малките квадрати. Въведете вашите данни, за да намерите OLS най-подходящото линейно уравнение y = mx + b с... | Value |

|---|

Statistics

| Statistic | Value |

|---|---|

| Standard Error | |

| Sample Size (n) | |

| Degrees of Freedom |

Chart

Решение стъпка по стъпка

Как да използвате Линия на регресия на най-малките квадрати

Best Fit Line

Find the unique line that minimizes the total distance from all data points.

Статистически резултат

Get the full equation y = a + bx, slope, intercept, and R-squared metrics.

Residual Analysis

Understand the deviation between observed values and model predictions.

The least squares method is the gold standard for linear regression in most scientific fields.

Какво представлява регресионната линия на най-малките квадрати?

📊 Регресионната линия на най-малките квадрати (LSRL) е правата линия, която минимизира сумата от квадратите на вертикалните разстояния между наблюдаваните точки от данни и линията. Математически, ако имаме n точки от данни (x₁, y₁), (x₂, y₂), …, (xₙ, yₙ), LSRL е линията ŷ = mx + b, която минимизира количеството Σ(yᵢ − ŷᵢ)², където ŷᵢ = mxᵢ + b са предвидените стойности.

🏆 Този критерий се нарича критерий на най-малките квадрати, а получената линия е известна също като линия на обикновени най-малки квадрати (OLS) или линия на най-добро съвпадение. Методът на най-малките квадрати има богата история, датираща от Адриен-Мари Лежандр през 1805 г., който го публикува като начин за определяне на орбитите на кометите, и Карл Фридрих Гаус, който твърди, че го използва от 1795 г. и по-късно го доразвива в своята теория за грешките.

⚠️ Името „най-малки квадрати“ идва директно от математическата цел: измежду всички възможни линии ние избираме тази, която прави сумата от остатъците на квадрат възможно най-малка — най-малката сума от квадрати. Поставянето на остатъците на квадрат (вместо да се вземат абсолютни стойности) гарантира, че положителните и отрицателните грешки не се компенсират взаимно и също така придава по-голяма тежест на по-големите отклонения, което е статистически желателно.

📊 Днес регресионната линия на най-малките квадрати е най-широко използваният метод за напасване на права линия през точки от данни в статистиката, икономиката, естествените науки, социалните науки и инженерството. Той служи като основа за по-напреднали техники, включително множествена регресия, обобщени линейни модели и алгоритми за машинно обучение. Всеки въвеждащ курс по статистика учи LSRL като крайъгълен камък на регресионния анализ.

Методът на най-малките квадрати

- 1 Изчислява линията, която минимизира сумата от остатъците на квадрат

- 2 Използва нормалните уравнения: Σ(y) = nb + mΣ(x) и Σ(xy) = bΣ(x) + mΣ(x²)

- 3 Решава за наклон m = SSxy / SSxx и пресечна точка b = ȳ - m·x̄

- 4 Осигурява R², стандартна грешка и всички междинни суми

Кога да използвате регресията на най-малките квадрати

- Анализ на линейни тенденции в бизнеса и икономиката

- Контрол на качеството и мониторинг на процесите

- Криви на калибриране в лабораторни условия

- Образователно преподаване на фундаментална статистика

- Всяка ситуация, изискваща най-подходящата права линия

Предположения за регресия на най-малките квадрати

- 1. Линейност: Връзката между X и Y трябва да е линейна. Проверете с диаграма на разсейване на Y спрямо X и остатъчна диаграма на остатъци спрямо прогнозирани стойности. Извит модел в която и да е диаграма показва нелинейност.

- 2. Независимост: Остатъците трябва да са независими — без автокорелация. Проверете с теста на Дърбин-Уотсън (d ≈ 2 означава липса на автокорелация). Данните от времеви редове често нарушават това предположение.

- 3. Хомоскедастичност: Остатъчната вариация трябва да бъде постоянна за всички прогнозирани стойности. Проверете с остатъчна графика (разпространението трябва да е приблизително равно) или теста на Breusch-Pagan. Формата на фуния показва хетероскедастичност.

- 4. Нормалност: Остатъците трябва да са приблизително нормално разпределени. Проверете с хистограма, нормална вероятностна графика (Q-Q графика) или теста на Jarque-Bera. Големите проби (n> 30) са по-устойчиви на нарушения.

- 5. Няма влиятелни отклонения: Единичен екстремен отклонение може драматично да измести регресионната линия. Проверете със стойностите на разстоянието или ливъриджа на Кук. Помислете за стабилна регресия, ако отклоненията не могат да бъдат премахнати.

- 6. Представителна извадка: Данните трябва да бъдат представителна извадка от съвкупността от интереси. Удобни извадки или съкратени диапазони могат да доведат до подвеждащи регресионни резултати.