Calcolatore di regressione multipla

Calcolare equazioni di regressione multipla con due o più predittori. Trova il modello migliore per i tuoi dati utilizzando il nostro strumento di analisi...

Calcolatore di regressione multipla

Calcolare equazioni di regressione multipla con due o più predittori. Trova il modello migliore per i tuoi dati utilizzando il nostro strumento di analisi...

Inserisci i tuoi punti dati

Risultati

R-quadrato

Adjusted R-Squared

Standard Error

Soluzione passo dopo passo

Come usare questo Calcolatore di regressione multipla

Complex Modeling

Analyze how multiple factors simultaneously influence your dependent variable.

Output statistico

Calculate partial coefficients, standard errors, and adjusted R-squared values.

Diagnostics

Built-in checks for multicollinearity and model significance.

Multiple regression helps isolate the effect of one variable while controlling for others.

Come calcolare la regressione multipla

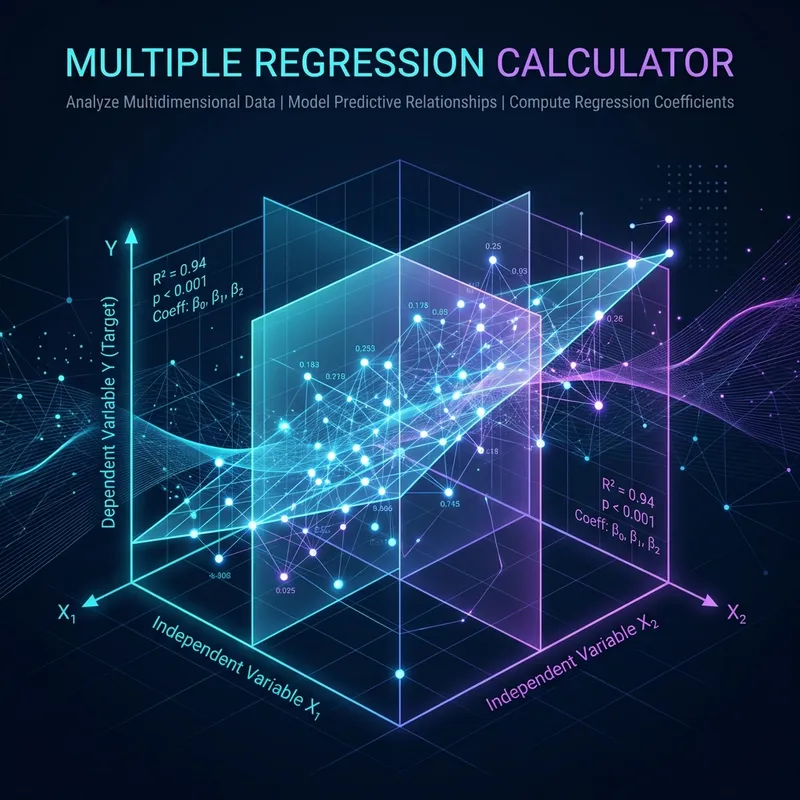

📐 La regressione multipla estende la regressione lineare semplice a due o più variabili predittive, producendo l'equazione y = b₀ + b₁x₁ + b₂x₂ + … + bₚxₚ, dove ciascun coefficiente bᵢ rappresenta l'effetto del predittore xᵢ su y mantenendo costanti tutti gli altri predittori.

❌ Questa proprietà di "mantenimento costante" è ciò che rende la regressione multipla così potente: consente di isolare il contributo unico di ciascun predittore, controllando i fattori di confondimento che altrimenti distorcerebbero i risultati. Ad esempio, se si desidera studiare l'effetto dell'istruzione sul reddito, la semplice regressione del reddito sull'istruzione confonderebbe l'effetto dell'istruzione con l'effetto dell'esperienza, perché le persone più istruite tendono anche ad avere più esperienza.

📐 La regressione multipla risolve questo problema includendo sia l'istruzione che l'esperienza come predittori, quindi ciascun coefficiente riflette l'effetto reale di quella sola variabile. La regressione multipla è la tecnica di regressione più utilizzata nella ricerca, nell'analisi aziendale, nelle scienze sociali, nella medicina e nell'apprendimento automatico perché i risultati del mondo reale dipendono quasi sempre da più fattori contemporaneamente.

📊 Un modello a predittore singolo raramente cattura una variazione sufficiente per essere utile: l'aggiunta di predittori pertinenti aumenta quasi sempre il potere esplicativo e migliora l'accuratezza della previsione. Le statistiche chiave riportate includono R² (la proporzione della varianza spiegata da tutti i predittori insieme), R² corretto (che penalizza l'aggiunta di predittori che non migliorano realmente il modello), la statistica F (che verifica se il modello complessivo è statisticamente significativo) e l'errore standard della stima (che misura la distanza media dei punti dati dall'iperpiano di regressione).

📊 Comprendere queste metriche è essenziale per costruire modelli affidabili ed evitarli. overfitting, che si verifica quando vengono inclusi troppi predittori rispetto alla dimensione del campione.