Línea de regresión de mínimos cuadrados

Calcule la línea de regresión de mínimos cuadrados al instante. Ingrese sus datos para encontrar la ecuación lineal de mejor ajuste de OLS y = mx + b con...

Línea de regresión de mínimos cuadrados

Calcule la línea de regresión de mínimos cuadrados al instante. Ingrese sus datos para encontrar la ecuación lineal de mejor ajuste de OLS y = mx + b con...

Ingrese sus puntos de datos

| # | incógnita | Y |

|---|

Results

Ecuación de regresión

Pendiente (m)

Intersección en Y (b)

R² (Coeficiente de Determinación)

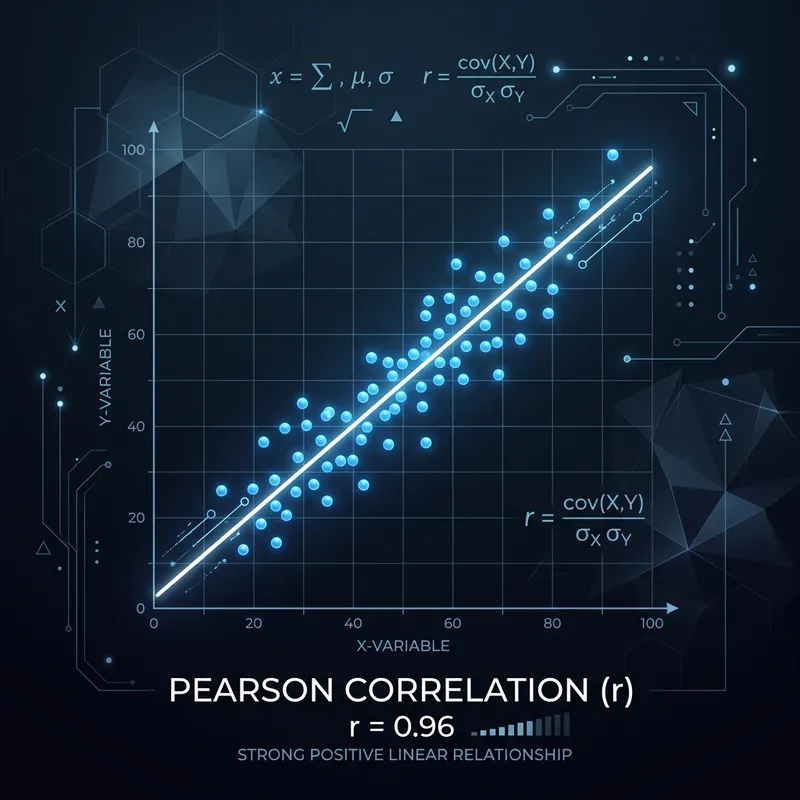

Correlation (r)

Y previsto

Intermediate Calculations

| Symbol | Calcule la línea de regresión de mínimos cuadrados al instante. Ingrese sus datos para encontrar la ecuación lineal de mejor ajuste de OLS y = mx + b con... | Value |

|---|

Statistics

| Statistic | Value |

|---|---|

| Standard Error | |

| Sample Size (n) | |

| Degrees of Freedom |

Chart

Solución paso a paso

Cómo usar esto Línea de regresión de mínimos cuadrados

Best Fit Line

Find the unique line that minimizes the total distance from all data points.

Resultados estadísticos

Get the full equation y = a + bx, slope, intercept, and R-squared metrics.

Residual Analysis

Understand the deviation between observed values and model predictions.

The least squares method is the gold standard for linear regression in most scientific fields.

¿Qué es la recta de regresión de mínimos cuadrados?

📊 La línea de regresión de mínimos cuadrados (LSRL) es la línea recta que minimiza la suma de las distancias verticales al cuadrado entre los puntos de datos observados y la línea. Matemáticamente, si tenemos n puntos de datos (x₁, y₁), (x₂, y₂), …, (xₙ, yₙ), el LSRL es la recta ŷ = mx + b que minimiza la cantidad Σ(yᵢ − ŷᵢ)², donde ŷᵢ = mxᵢ + b son los valores predichos. valores.

🏆 Este criterio se llama criterio de mínimos cuadrados y la línea resultante también se conoce como línea de mínimos cuadrados ordinarios (OLS) o línea de mejor ajuste. El método de mínimos cuadrados tiene una rica historia que se remonta a Adrien-Marie Legendre en 1805, quien lo publicó como una forma de determinar las órbitas de los cometas, y a Carl Friedrich Gauss, quien afirmó haberlo estado utilizando desde 1795 y luego lo desarrolló aún más en su teoría de los errores.

⚠️ El nombre "mínimos cuadrados" proviene directamente del objetivo matemático: entre todas las líneas posibles, nosotros elija el que haga que la suma de los residuos al cuadrado sea lo más pequeña posible: la menor suma de cuadrados. Cuadrar los residuos (en lugar de tomar valores absolutos) garantiza que los errores positivos y negativos no se cancelen entre sí, y también da más peso a las desviaciones mayores, lo cual es estadísticamente deseable.

📊 Hoy en día, la línea de regresión de mínimos cuadrados es el método más utilizado para ajustar una línea recta a través de puntos de datos en estadística, economía, ciencias naturales, ciencias sociales e ingeniería. Sirve como base para técnicas más avanzadas que incluyen regresión múltiple, modelos lineales generalizados y algoritmos de aprendizaje automático. Cada curso de introducción a la estadística enseña el LSRL como la piedra angular del análisis de regresión.

El método de mínimos cuadrados

- 1 Calcula la recta que minimiza la suma de los residuos al cuadrado.

- 2 Utiliza las ecuaciones normales: Σ(y) = nb + mΣ(x) y Σ(xy) = bΣ(x) + mΣ(x²)

- 3 Resuelve para pendiente m = SSxy / SSxx e interceptar b = ȳ - m·x̄

- 4 Proporciona R², error estándar y todas las sumas intermedias.

Cuándo utilizar la regresión de mínimos cuadrados

- Análisis de tendencias lineales en negocios y economía.

- Control de calidad y seguimiento de procesos.

- Curvas de calibración en entornos de laboratorio.

- Enseñanza educativa de la estadística fundamental.

- Cualquier situación que requiera la línea recta de mejor ajuste

Supuestos de regresión de mínimos cuadrados

- 1. Linealidad: La relación entre X e Y debe ser lineal. Verifique con un diagrama de dispersión de Y frente a X y un diagrama de residuos frente a los valores previstos. Un patrón curvo en cualquiera de los gráficos indica no linealidad.

- 2. Independencia: los residuos deben ser independientes, sin autocorrelación. Verifique con la prueba de Durbin-Watson (d ≈ 2 significa que no hay autocorrelación). Los datos de series temporales a menudo violan este supuesto.

- 3. Homoscedasticidad: la varianza residual debe ser constante en todos los valores predichos. Verifique con una gráfica residual (la dispersión debe ser aproximadamente igual) o la prueba de Breusch-Pagan. Una forma de embudo indica heterocedasticidad.

- 4. Normalidad: Los residuos deben tener una distribución aproximadamente normal. Verifique con un histograma, un gráfico de probabilidad normal (gráfico Q-Q) o la prueba de Jarque-Bera. Las muestras grandes (n> 30) son más resistentes a las violaciones.

- 5. Sin valores atípicos influyentes: un único valor atípico extremo puede cambiar drásticamente la línea de regresión. Consulte con los valores de distancia o apalancamiento de Cook. Considere una regresión robusta si no se pueden eliminar los valores atípicos.

- 6. Muestreo representativo: Los datos deben ser una muestra representativa de la población de interés. Las muestras de conveniencia o los rangos truncados pueden producir resultados de regresión engañosos.