Calculadora de regresión múltiple

Calcule ecuaciones de regresión múltiples con dos o más predictores. Encuentre el mejor modelo para sus datos utilizando nuestra herramienta gratuita de...

Calculadora de regresión múltiple

Calcule ecuaciones de regresión múltiples con dos o más predictores. Encuentre el mejor modelo para sus datos utilizando nuestra herramienta gratuita de...

Ingrese sus puntos de datos

Resultados

R cuadrado

Adjusted R-Squared

Standard Error

Solución paso a paso

Cómo usar esto Calculadora de regresión múltiple

Complex Modeling

Analyze how multiple factors simultaneously influence your dependent variable.

Resultados estadísticos

Calculate partial coefficients, standard errors, and adjusted R-squared values.

Diagnostics

Built-in checks for multicollinearity and model significance.

Multiple regression helps isolate the effect of one variable while controlling for others.

Cómo calcular la regresión múltiple

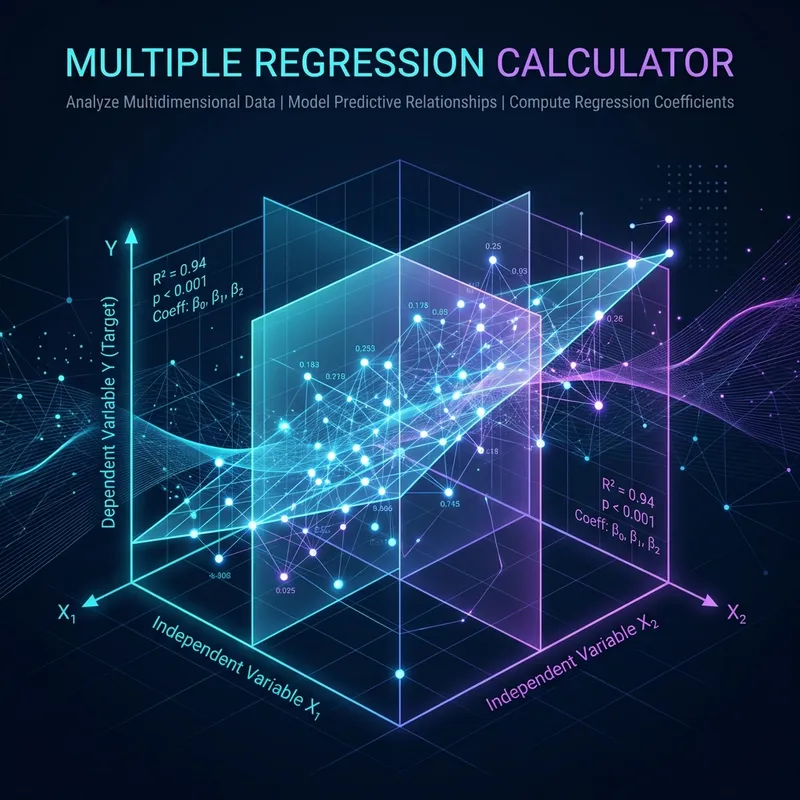

📐 La regresión múltiple extiende la regresión lineal simple a dos o más variables predictivas, produciendo la ecuación y = b₀ + b₁x₁ + b₂x₂ + … + bₚxₚ, donde cada coeficiente bᵢ representa el efecto del predictor xᵢ sobre y mientras se mantienen constantes todos los demás predictores.

❌ Esto La propiedad de "mantener constante" es lo que hace que la regresión múltiple sea tan poderosa: le permite aislar la contribución única de cada predictor, controlando los factores de confusión que de otro modo distorsionarían sus resultados. Por ejemplo, si desea estudiar el efecto de la educación sobre los ingresos, simplemente hacer una regresión de los ingresos sobre la educación combinaría el efecto de la educación con el efecto de la experiencia, porque las personas más educadas también tienden a tener más experiencia.

📐 La regresión múltiple resuelve esto incluyendo tanto la educación como la experiencia como predictores, de modo que cada coeficiente refleje el efecto genuino de esa variable por sí sola. La regresión múltiple es la técnica de regresión más utilizada en investigación, análisis de negocios, ciencias sociales, medicina y aprendizaje automático porque los resultados del mundo real casi siempre dependen de múltiples factores simultáneamente.

📊 Un modelo de predictor único rara vez captura suficiente variación como para ser útil: agregar predictores relevantes casi siempre aumenta el poder explicativo y mejora la precisión de la predicción. Las estadísticas clave reportadas incluyen R² (la proporción de varianza explicada por todos los predictores juntos), R² ajustado (que penaliza por agregar predictores que no mejoran genuinamente el modelo), la estadística F (que prueba si el modelo general es estadísticamente significativo) y el error estándar de la estimación (que mide la distancia promedio de los puntos de datos desde el hiperplano de regresión).

📊 Comprender estas métricas es esencial para construir modelos confiables y evitando el sobreajuste, que ocurre cuando se incluyen demasiados predictores en relación con el tamaño de la muestra.