최소제곱 회귀선

최소 제곱 회귀선을 즉시 계산합니다. 포괄적인 수학 솔루션을 사용하여 OLS에 가장 적합한 선 방정식 y = mx + b를 찾으려면 데이터를 입력하세요.

최소제곱 회귀선

최소 제곱 회귀선을 즉시 계산합니다. 포괄적인 수학 솔루션을 사용하여 OLS에 가장 적합한 선 방정식 y = mx + b를 찾으려면 데이터를 입력하세요.

데이터 포인트를 입력하세요

| # | 엑스 | 와이 |

|---|

Results

회귀 방정식

경사(m)

Y절편(b)

R²(결정계수)

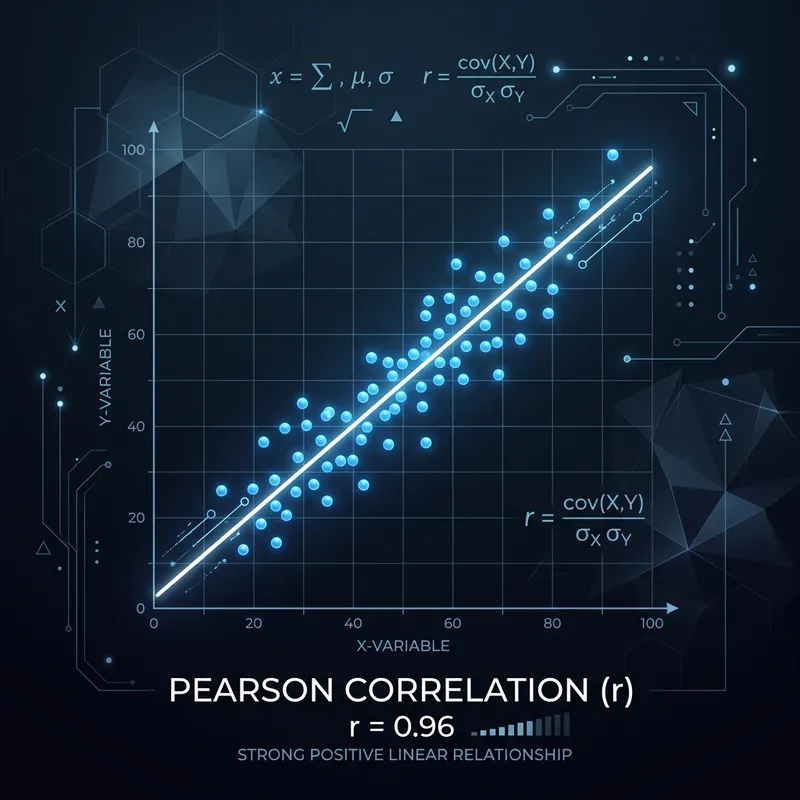

Correlation (r)

예측된 Y

Intermediate Calculations

| Symbol | 최소 제곱 회귀선을 즉시 계산합니다. 포괄적인 수학 솔루션을 사용하여 OLS에 가장 적합한 선 방정식 y = mx + b를 찾으려면 데이터를 입력하세요. | Value |

|---|

Statistics

| Statistic | Value |

|---|---|

| Standard Error | |

| Sample Size (n) | |

| Degrees of Freedom |

Chart

단계별 솔루션

사용 방법 최소제곱 회귀선

Best Fit Line

Find the unique line that minimizes the total distance from all data points.

통계 출력

Get the full equation y = a + bx, slope, intercept, and R-squared metrics.

Residual Analysis

Understand the deviation between observed values and model predictions.

The least squares method is the gold standard for linear regression in most scientific fields.

최소제곱 회귀선이란 무엇입니까?

📊 최소 제곱 회귀선(LSRL)은 관측된 데이터 포인트와 선 사이의 수직 거리 제곱의 합을 최소화하는 직선입니다. 수학적으로 n개의 데이터 포인트(x₁, y₁), (x2, y2), …, (xₙ, yₙ)가 있는 경우 LSRL은 Σ(yᵢ − ŷᵢ)² 수량을 최소화하는 ŷ = mx + b 라인입니다. 여기서 ŷᵢ = mxᵢ + b는 예측값입니다. 값.

🏆 이 기준을 최소 제곱 기준이라고 하며, 결과 선은 OLS(Ordinary Least Squares) 선 또는 최적선이라고도 합니다. 최소 제곱법은 혜성의 궤도를 결정하는 방법으로 이 방법을 발표한 1805년 Adrien-Marie Legendre와 1795년부터 이 방법을 사용했으며 나중에 오류 이론에서 이 방법을 더욱 발전시켰다고 주장한 Carl Friedrich Gauss로 거슬러 올라가는 풍부한 역사를 가지고 있습니다.

⚠️ '최소 제곱법'이라는 이름은 가능한 모든 것 중 수학적 목적에서 직접 유래되었습니다. 선에서 잔차 제곱의 합을 가능한 한 작게 만드는 선, 즉 제곱의 최소 합을 선택합니다. 절대값을 사용하는 대신 잔차를 제곱하면 양수 오류와 음수 오류가 서로 상쇄되지 않고 더 큰 편차에 더 많은 가중치를 부여하므로 통계적으로 바람직합니다.

📊 오늘날 최소 제곱 회귀선은 통계, 경제학, 자연과학, 사회과학 및 공학 분야에서 데이터 포인트를 직선으로 맞추는 데 가장 널리 사용되는 방법입니다. 이는 다중 회귀, 일반화된 선형 모델, 기계 학습 알고리즘을 포함한 고급 기술의 기반 역할을 합니다. 모든 통계 입문 과정에서는 회귀 분석의 초석인 LSRL을 가르칩니다.

최소제곱법

- 1 잔차 제곱합을 최소화하는 선을 계산합니다.

- 2 일반 방정식을 사용합니다: Σ(y) = nb + mΣ(x) 및 Σ(xy) = bΣ(x) + mΣ(x²)

- 3 기울기 m = SSxy / SSxx 및 절편 b = å - m·x̄를 구합니다.

- 4 R², 표준 오차 및 모든 중간합을 제공합니다.

최소 제곱 회귀를 사용해야 하는 경우

- 비즈니스 및 경제 분야의 선형 추세 분석

- 품질 관리 및 공정 모니터링

- 실험실 환경의 교정 곡선

- 기초통계 교육교육

- 가장 잘 맞는 직선이 필요한 모든 상황

최소 제곱 회귀의 가정

- 1. 선형성: X와 Y 사이의 관계는 선형이어야 합니다. Y 대 X의 산점도와 잔차 대 예측 값의 잔차 도표로 확인하세요. 두 플롯의 곡선 패턴은 비선형성을 나타냅니다.

- 2. 독립성: 잔차는 독립적이어야 하며 자기상관이 없어야 합니다. Durbin-Watson 테스트를 통해 확인하십시오(d ≒ 2는 자기상관이 없음을 의미함). 시계열 데이터는 종종 이 가정을 위반합니다.

- 3. 균등성: 잔차 분산은 모든 예측 값에서 일정해야 합니다. 잔차 도표(확산은 대략 동일해야 함) 또는 Breusch-Pagan 검정으로 확인하십시오. 깔때기 모양은 이분산성을 나타냅니다.

- 4. 정규성: 잔차는 대략 정규 분포를 따라야 합니다. 히스토그램, 정규 확률도(Q-Q 플롯) 또는 Jarque-Bera 테스트를 통해 확인하십시오. 큰 샘플(n> 30)은 위반에 더 강력합니다.

- 5. 영향력 있는 이상값 없음: 하나의 극단적인 이상값이 회귀선을 극적으로 이동할 수 있습니다. Cook의 거리나 레버리지 값을 확인하세요. 이상값을 제거할 수 없는 경우 로버스트 회귀를 고려하세요.

- 6. 대표 표본 추출: 데이터는 관심 집단의 대표 표본이어야 합니다. 편의 표본이나 잘린 범위는 잘못된 회귀 결과를 생성할 수 있습니다.