Calculadora de regressão múltipla

Calcule múltiplas equações de regressão com dois ou mais preditores. Encontre o melhor modelo para seus dados usando nossa ferramenta de análise...

Calculadora de regressão múltipla

Calcule múltiplas equações de regressão com dois ou mais preditores. Encontre o melhor modelo para seus dados usando nossa ferramenta de análise...

Insira seus pontos de dados

Resultados

R-quadrado

Adjusted R-Squared

Standard Error

Solução passo a passo

Como usar isto Calculadora de regressão múltipla

Complex Modeling

Analyze how multiple factors simultaneously influence your dependent variable.

Saída estatística

Calculate partial coefficients, standard errors, and adjusted R-squared values.

Diagnostics

Built-in checks for multicollinearity and model significance.

Multiple regression helps isolate the effect of one variable while controlling for others.

Como calcular a regressão múltipla

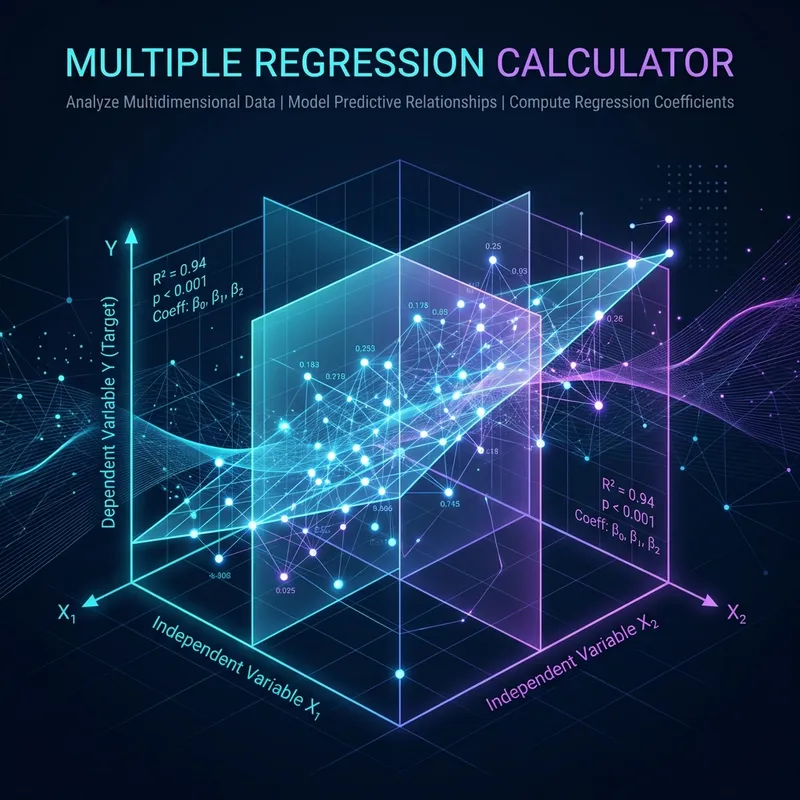

📐 A regressão múltipla estende a regressão linear simples para duas ou mais variáveis preditoras, produzindo a equação y = b₀ + b₁x₁ + b₂x₂ + … + bₚxₚ, onde cada coeficiente bᵢ representa o efeito do preditor xᵢ em y enquanto mantém todos os outros preditores constantes.

❌ Isso A propriedade "manter constante" é o que torna a regressão múltipla tão poderosa - ela permite isolar a contribuição exclusiva de cada preditor, controlando fatores de confusão que, de outra forma, distorceriam seus resultados. Por exemplo, se você quiser estudar o efeito da educação sobre a renda, simplesmente regredir a renda sobre a educação combinaria o efeito da educação com o efeito da experiência, porque pessoas mais instruídas também tendem a ter mais experiência.

📐 A regressão múltipla resolve isso incluindo a educação e a experiência como preditores, de modo que cada coeficiente reflita o efeito genuíno daquela variável sozinha. A regressão múltipla é a técnica de regressão mais amplamente usada em pesquisa, análise de negócios, ciências sociais, medicina e aprendizado de máquina porque os resultados do mundo real quase sempre dependem de vários fatores simultaneamente.

📊 Um modelo de preditor único raramente captura variação suficiente para ser útil – adicionar preditores relevantes quase sempre aumenta o poder explicativo e melhora a precisão da previsão. As principais estatísticas relatadas incluem R² (a proporção de variância explicada por todos os preditores juntos), R² ajustado (que penaliza a adição de preditores que não melhoram genuinamente o modelo), a estatística F (que testa se o modelo geral é estatisticamente significativo) e o erro padrão da estimativa (que mede a distância média dos pontos de dados do hiperplano de regressão).

📊 Compreender essas métricas é essencial para construir modelos confiáveis e evitar overfitting, o que ocorre quando muitos preditores são incluídos em relação ao tamanho da amostra.