Линия регрессии по методу наименьших квадратов

Мгновенно вычислите линию регрессии по методу наименьших квадратов. Введите свои данные, чтобы найти наиболее подходящее линейное уравнение OLS y = mx + b...

Линия регрессии по методу наименьших квадратов

Мгновенно вычислите линию регрессии по методу наименьших квадратов. Введите свои данные, чтобы найти наиболее подходящее линейное уравнение OLS y = mx + b...

Введите свои данные

| # | Х | Да |

|---|

Results

Уравнение регрессии

Уклон (м)

Y-перехват (б)

R² (коэффициент детерминации)

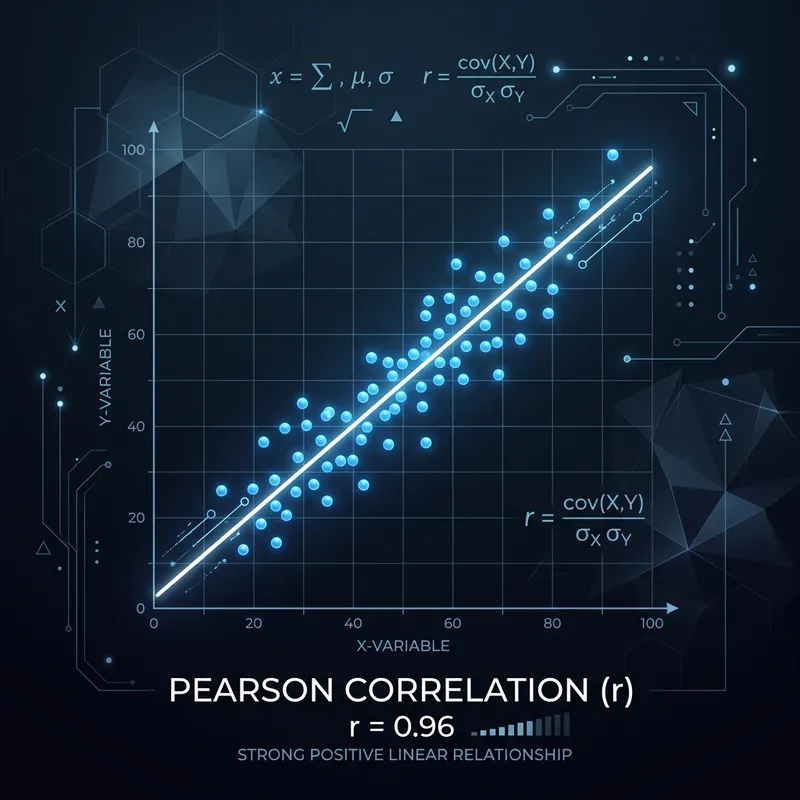

Correlation (r)

Прогнозируемый Y

Intermediate Calculations

| Symbol | Мгновенно вычислите линию регрессии по методу наименьших квадратов. Введите свои данные, чтобы найти наиболее подходящее линейное уравнение OLS y = mx + b... | Value |

|---|

Statistics

| Statistic | Value |

|---|---|

| Standard Error | |

| Sample Size (n) | |

| Degrees of Freedom |

Chart

Пошаговое решение

Как использовать Линия регрессии по методу наименьших квадратов

Best Fit Line

Find the unique line that minimizes the total distance from all data points.

Статистический вывод

Get the full equation y = a + bx, slope, intercept, and R-squared metrics.

Residual Analysis

Understand the deviation between observed values and model predictions.

The least squares method is the gold standard for linear regression in most scientific fields.

Что такое линия регрессии по методу наименьших квадратов?

📊 Линия регрессии наименьших квадратов (LSRL) – это прямая линия, которая минимизирует сумму квадратов вертикальных расстояний между наблюдаемыми точками данных и линией. Математически, если у нас есть n точек данных (x₁, y₁), (x₂, y₂), …, (xₙ, yₙ), LSRL — это линия ŷ = mx + b, которая минимизирует величину Σ(yᵢ − ŷᵢ)², где ŷᵢ = mxᵢ + b — предсказанные значения.

🏆 Этот критерий называется критерием наименьших квадратов, а полученная линия также известна как линия обычных наименьших квадратов (OLS) или линия наилучшего соответствия. Метод наименьших квадратов имеет богатую историю, восходящую к Адриену-Мари Лежандру в 1805 году, который опубликовал его как способ определения орбит комет, и Карлу Фридриху Гауссу, который утверждал, что использовал его с 1795 года, а затем развил его дальше в своей теории ошибок.

⚠️ Название «наименьших квадратов» происходит непосредственно от математической цели: среди всех возможных линий, мы выбираем ту, которая делает сумму квадратов остатков как можно меньшей — наименьшую сумму квадратов. Возведение остатков в квадрат (вместо того, чтобы брать абсолютные значения) гарантирует, что положительные и отрицательные ошибки не компенсируют друг друга, а также придает больший вес большим отклонениям, что статистически желательно.

📊 Сегодня линия регрессии наименьших квадратов является наиболее широко используемым методом построения прямой линии через точки данных в статистике, экономике, естественных науках, социальных науках и технике. Он служит основой для более продвинутых методов, включая множественную регрессию, обобщенные линейные модели и алгоритмы машинного обучения. В каждом вводном курсе статистики LSRL рассматривается как краеугольный камень регрессионного анализа.

Метод наименьших квадратов

- 1 Вычисляет линию, которая минимизирует сумму квадратов остатков

- 2 Использует обычные уравнения: Σ(y) = nb + mΣ(x) и Σ(xy) = bΣ(x) + mΣ(x²).

- 3 Определяет наклон m = SSxy / SSxx и точку пересечения b = ş - m·x̄.

- 4 Предоставляет R², стандартную ошибку и все промежуточные суммы.

Когда использовать регрессию наименьших квадратов

- Линейный анализ тенденций в бизнесе и экономике

- Контроль качества и мониторинг процессов

- Калибровочные кривые в лабораторных условиях

- Образовательное преподавание фундаментальной статистики

- Любая ситуация, требующая наилучшей прямой линии

Предположения регрессии наименьших квадратов

- 1. Линейность. Связь между X и Y должна быть линейной. Проверьте график рассеяния Y по сравнению с X и график остатков по сравнению с прогнозируемыми значениями. Изогнутый узор на любом графике указывает на нелинейность.

- 2. Независимость. Остатки должны быть независимыми — никакой автокорреляции. Проверьте с помощью теста Дурбина-Ватсона (d ≈ 2 означает отсутствие автокорреляции). Данные временных рядов часто нарушают это предположение.

- 3. Гомоскедастичность: Остаточная дисперсия должна быть постоянной для всех прогнозируемых значений. Проверьте график остатков (разброс должен быть примерно равным) или тест Бреуша-Пэгана. Форма воронки указывает на гетероскедастичность.

- 4. Нормальность. Остатки должны быть примерно нормально распределены. Проверьте с помощью гистограммы, графика нормальной вероятности (график QQ) или теста Жара-Бера. Большие выборки (n> 30) более устойчивы к нарушениям.

- 5. Нет влиятельных выбросов. Один крайний выброс может резко сдвинуть линию регрессии. Сверьтесь со значениями дистанции Кука или кредитного плеча. Рассмотрите робастную регрессию, если выбросы невозможно удалить.

- 6. Репрезентативная выборка. Данные должны представлять собой репрезентативную выборку интересующей совокупности. Удобные выборки или усеченные диапазоны могут привести к ошибочным результатам регрессии.