Калькулятор множественной регрессии

Вычислите уравнения множественной регрессии с двумя или более предикторами. Найдите лучшую модель для ваших данных, используя наш бесплатный...

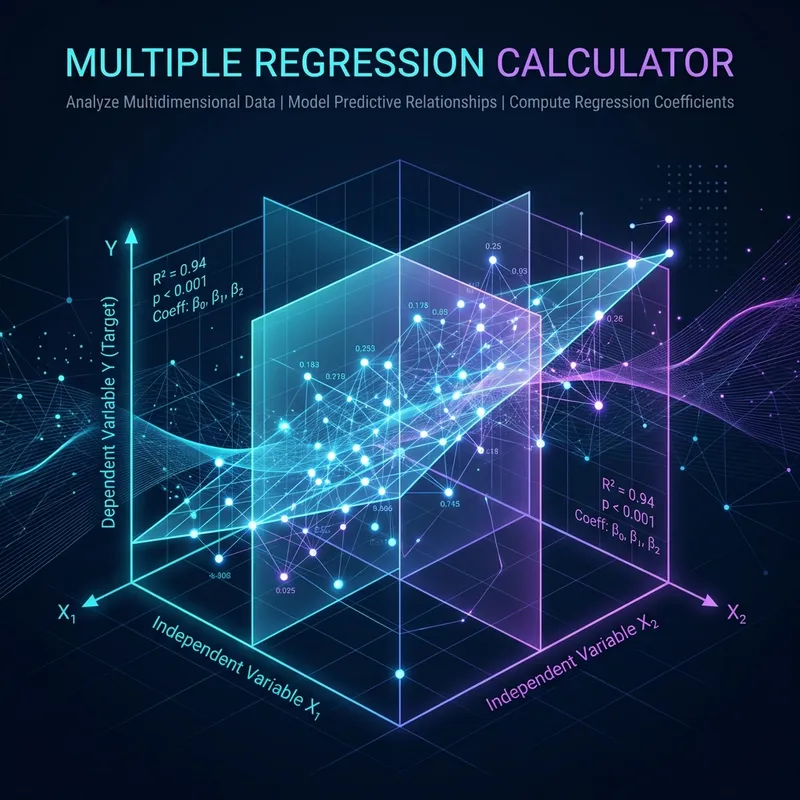

Калькулятор множественной регрессии

Вычислите уравнения множественной регрессии с двумя или более предикторами. Найдите лучшую модель для ваших данных, используя наш бесплатный...

Введите свои данные

Результаты

R-квадрат

Adjusted R-Squared

Standard Error

Пошаговое решение

Как использовать Калькулятор множественной регрессии

Complex Modeling

Analyze how multiple factors simultaneously influence your dependent variable.

Статистический вывод

Calculate partial coefficients, standard errors, and adjusted R-squared values.

Diagnostics

Built-in checks for multicollinearity and model significance.

Multiple regression helps isolate the effect of one variable while controlling for others.

Как рассчитать множественную регрессию

📐 Множественная регрессия расширяет простую линейную регрессию до двух или более переменных-предикторов, создавая уравнение y = b₀ + b₁x₁ + b₂x₂ + … + bₚxₚ, где каждый коэффициент bᵢ представляет влияние предиктора xᵢ на y, при сохранении всех остальных предикторов константа.

❌ Именно это свойство «удержания константы» делает множественную регрессию такой мощной — оно позволяет изолировать уникальный вклад каждого предиктора, контролируя факторы, которые в противном случае исказили бы ваши результаты. Например, если вы хотите изучить влияние образования на доход, простая регрессия дохода на образование объединит влияние образования с влиянием опыта, потому что более образованные люди также, как правило, имеют больше опыта.

📐 Множественная регрессия решает эту проблему, включая образование и опыт в качестве предикторов, поэтому каждый коэффициент отражает истинное влияние только этой переменной. Множественная регрессия — наиболее широко используемый метод регрессии в исследованиях, бизнес-аналитике, социальных науках, медицине и машинном обучении, поскольку реальные результаты почти всегда зависят от нескольких факторов одновременно.

📊 Модель с одним предиктором редко отражает достаточно вариаций, чтобы быть полезной — добавление соответствующих предикторов почти всегда увеличивает объяснительную силу и повышает точность прогнозирования. К ключевым статистическим данным относятся R² (доля дисперсии, объясняемая всеми предикторами вместе), скорректированный R² (который наказывает за добавление предикторов, которые действительно не улучшают модель), F-статистика (которая проверяет, является ли общая модель статистически значимой) и стандартную ошибку оценки (которая измеряет среднее расстояние точек данных от гиперплоскости регрессии).

📊 Понимание этих показателей важно для построения надежных показателей. модели и избежать переобучения, которое происходит, когда включено слишком много предикторов относительно размера выборки.