Regressionslinie der kleinsten Quadrate

Berechnen Sie sofort die Regressionslinie der kleinsten Quadrate. Geben Sie Ihre Daten ein, um die OLS-Best-Fit-Liniengleichung y = mx + b mit umfassenden...

Regressionslinie der kleinsten Quadrate

Berechnen Sie sofort die Regressionslinie der kleinsten Quadrate. Geben Sie Ihre Daten ein, um die OLS-Best-Fit-Liniengleichung y = mx + b mit umfassenden...

Geben Sie Ihre Datenpunkte ein

| # | X | Y |

|---|

Results

Regressionsgleichung

Steigung (m)

Y-Achsenabschnitt (b)

R² (Bestimmtheitsmaß)

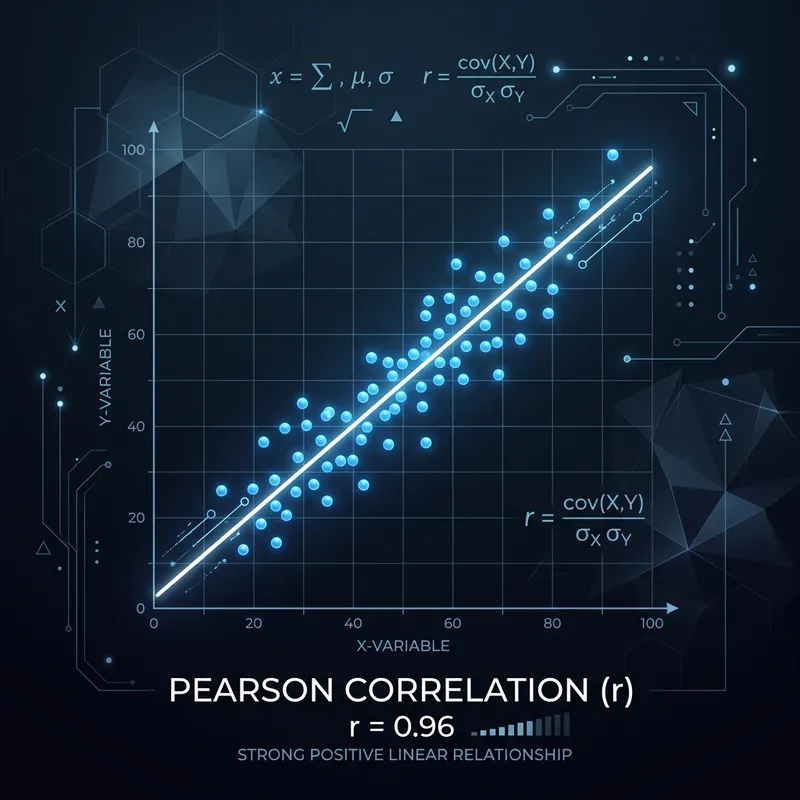

Correlation (r)

Vorhergesagtes Y

Intermediate Calculations

| Symbol | Berechnen Sie sofort die Regressionslinie der kleinsten Quadrate. Geben Sie Ihre Daten ein, um die OLS-Best-Fit-Liniengleichung y = mx + b mit umfassenden... | Value |

|---|

Statistics

| Statistic | Value |

|---|---|

| Standard Error | |

| Sample Size (n) | |

| Degrees of Freedom |

Chart

Schritt-für-Schritt-Lösung

So verwenden Sie dies Regressionslinie der kleinsten Quadrate

Best Fit Line

Find the unique line that minimizes the total distance from all data points.

Statistische Ausgabe

Get the full equation y = a + bx, slope, intercept, and R-squared metrics.

Residual Analysis

Understand the deviation between observed values and model predictions.

The least squares method is the gold standard for linear regression in most scientific fields.

Was ist die Regressionslinie der kleinsten Quadrate?

📊 Die Regressionslinie der kleinsten Quadrate (LSRL) ist die gerade Linie, die die Summe der quadrierten vertikalen Abstände zwischen beobachteten Datenpunkten und der Linie minimiert. Wenn wir n Datenpunkte (x₁, y₁), (x₂, y₂), …, (xₙ, yₙ) haben, ist die LSRL mathematisch gesehen die Linie ŷ = mx + b, die die Menge Σ(yᵢ − ŷᵢ)² minimiert, wobei ŷᵢ = mxᵢ + b die vorhergesagten Werte sind Werte.

🏆 Dieses Kriterium wird als Kriterium der kleinsten Quadrate bezeichnet, und die resultierende Linie wird auch als OLS-Linie (Ordinary Least Squares) oder Linie der besten Anpassung bezeichnet. Die Methode der kleinsten Quadrate hat eine lange Geschichte, die auf Adrien-Marie Legendre im Jahr 1805 zurückgeht, der sie als Methode zur Bestimmung der Umlaufbahnen von Kometen veröffentlichte, und auf Carl Friedrich Gauß, der behauptete, er habe sie seit 1795 verwendet und sie später in seiner Fehlertheorie weiterentwickelt.

⚠️ Der Name „kleinste Quadrate“ kommt direkt vom mathematischen Ziel: Unter allen möglichen Linien Wir wählen diejenige, die die Summe der quadrierten Residuen so klein wie möglich macht – die kleinste Summe der Quadrate. Das Quadrieren der Residuen (anstatt Absolutwerte zu nehmen) stellt sicher, dass sich positive und negative Fehler nicht gegenseitig aufheben, und verleiht größeren Abweichungen außerdem mehr Gewicht, was statistisch wünschenswert ist.

📊 Heutzutage ist die Regressionsgerade der kleinsten Quadrate die am weitesten verbreitete Methode zum Anpassen einer geraden Linie durch Datenpunkte in Statistik, Wirtschaft, Naturwissenschaften, Sozialwissenschaften und Ingenieurwesen. Es dient als Grundlage für fortgeschrittenere Techniken, einschließlich multipler Regression, verallgemeinerter linearer Modelle und Algorithmen für maschinelles Lernen. In jedem Einführungskurs in die Statistik wird die LSRL als Eckpfeiler der Regressionsanalyse vermittelt.

Die Methode der kleinsten Quadrate

- 1 Berechnet die Linie, die die Summe der quadrierten Residuen minimiert

- 2 Verwendet die Normalgleichungen: Σ(y) = nb + mΣ(x) und Σ(xy) = bΣ(x) + mΣ(x²)

- 3 Löst nach Steigung m = SSxy / SSxx und Achsenabschnitt b = ȳ - m·x̄

- 4 Stellt R², Standardfehler und alle Zwischensummen bereit

Wann sollte die Regression der kleinsten Quadrate verwendet werden?

- Lineare Trendanalyse in den Wirtschaftswissenschaften

- Qualitätskontrolle und Prozessüberwachung

- Kalibrierungskurven in Laborumgebungen

- Pädagogische Vermittlung grundlegender Statistik

- Jede Situation, in der die optimale gerade Linie erforderlich ist

Annahmen der Regression der kleinsten Quadrate

- 1. Linearität: Die Beziehung zwischen X und Y muss linear sein. Überprüfen Sie dies mit einem Streudiagramm von Y vs. X und einem Residuendiagramm der Residuen vs. vorhergesagten Werten. Ein gekrümmtes Muster in beiden Diagrammen weist auf Nichtlinearität hin.

- 2. Unabhängigkeit: Residuen müssen unabhängig sein – keine Autokorrelation. Überprüfen Sie mit dem Durbin-Watson-Test (d ≈ 2 bedeutet keine Autokorrelation). Zeitreihendaten verstoßen häufig gegen diese Annahme.

- 3. Homoskedastizität: Die Restvarianz muss über alle vorhergesagten Werte hinweg konstant sein. Überprüfen Sie dies mit einem Restdiagramm (Spreizung sollte ungefähr gleich sein) oder dem Breusch-Pagan-Test. Eine Trichterform weist auf Heteroskedastizität hin.

- 4. Normalität: Residuen sollten ungefähr normalverteilt sein. Überprüfen Sie dies mit einem Histogramm, einem normalen Wahrscheinlichkeitsdiagramm (Q-Q-Diagramm) oder dem Jarque-Bera-Test. Große Stichproben (n> 30) sind robuster gegenüber Verstößen.

- 5. Keine einflussreichen Ausreißer: Ein einzelner extremer Ausreißer kann die Regressionslinie dramatisch verschieben. Überprüfen Sie die Entfernungs- oder Hebelwirkungswerte von Cook. Erwägen Sie eine robuste Regression, wenn Ausreißer nicht entfernt werden können.

- 6. Repräsentative Stichprobe: Die Daten sollten eine repräsentative Stichprobe der interessierenden Bevölkerung sein. Zweckmäßige Stichproben oder abgeschnittene Bereiche können zu irreführenden Regressionsergebnissen führen.