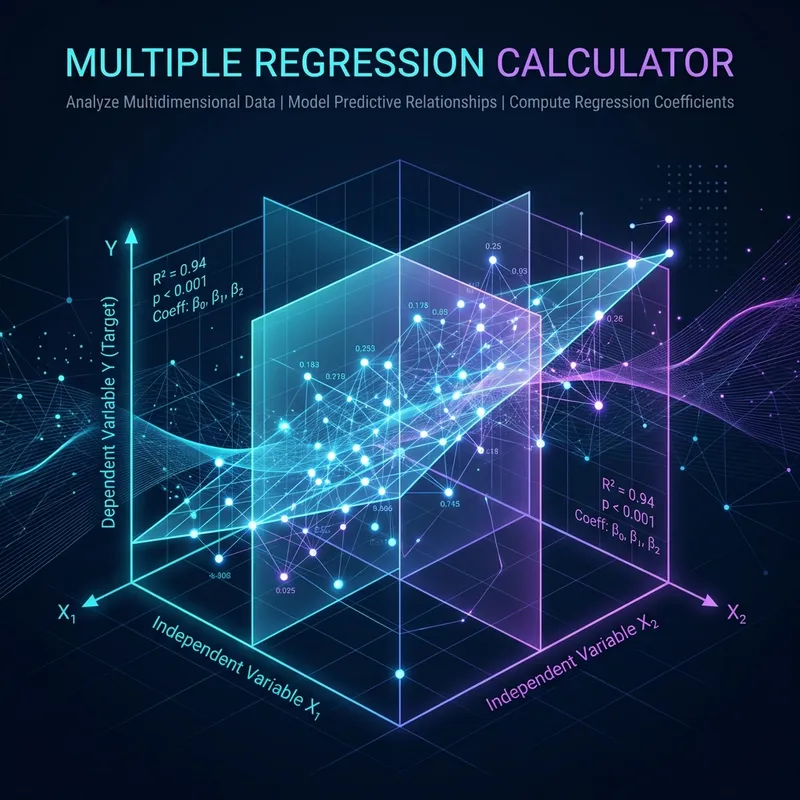

Rechner für multiple Regression

Berechnen Sie mehrere Regressionsgleichungen mit zwei oder mehr Prädiktoren. Finden Sie mit unserem kostenlosen Online-Tool zur statistischen Analyse das...

Rechner für multiple Regression

Berechnen Sie mehrere Regressionsgleichungen mit zwei oder mehr Prädiktoren. Finden Sie mit unserem kostenlosen Online-Tool zur statistischen Analyse das...

Geben Sie Ihre Datenpunkte ein

Ergebnisse

R-Quadrat

Adjusted R-Squared

Standard Error

Schritt-für-Schritt-Lösung

So verwenden Sie dies Rechner für multiple Regression

Complex Modeling

Analyze how multiple factors simultaneously influence your dependent variable.

Statistische Ausgabe

Calculate partial coefficients, standard errors, and adjusted R-squared values.

Diagnostics

Built-in checks for multicollinearity and model significance.

Multiple regression helps isolate the effect of one variable while controlling for others.

So berechnen Sie die multiple Regression

📐 Multiple Regression erweitert die einfache lineare Regression auf zwei oder mehr Prädiktorvariablen und erzeugt die Gleichung y = b₀ + b₁x₁ + b₂x₂ + … + bₚxₚ, wobei jeder Koeffizient bᵢ die Wirkung des Prädiktors xᵢ auf y darstellt während alle anderen Prädiktoren beibehalten werden konstant.

❌ Diese „Konstanthalten“-Eigenschaft macht die multiple Regression so leistungsstark – sie ermöglicht es Ihnen, den einzigartigen Beitrag jedes Prädiktors zu isolieren und Störfaktoren zu kontrollieren, die andernfalls Ihre Ergebnisse verzerren würden. Wenn Sie beispielsweise die Auswirkung von Bildung auf das Einkommen untersuchen möchten, würde eine einfache Regression des Einkommens auf die Bildung die Auswirkung von Bildung mit der Auswirkung von Erfahrung vermischen, da gebildetere Menschen tendenziell auch über mehr Erfahrung verfügen.

📐 Multiple Regression löst dieses Problem, indem sie sowohl Bildung als auch Erfahrung als Prädiktoren einbezieht, sodass jeder Koeffizient die tatsächliche Auswirkung dieser Variablen allein widerspiegelt. Multiple Regression ist die am weitesten verbreitete Regressionstechnik in Forschung, Geschäftsanalyse, Sozialwissenschaften, Medizin und maschinellem Lernen, da reale Ergebnisse fast immer von mehreren Faktoren gleichzeitig abhängen.

📊 Ein Einzelprädiktormodell erfasst selten genug Variationen, um nützlich zu sein – das Hinzufügen relevanter Prädiktoren erhöht fast immer die Erklärungskraft und verbessert die Vorhersagegenauigkeit. Zu den gemeldeten Schlüsselstatistiken gehören R² (der Anteil der Varianz, der durch alle Prädiktoren zusammen erklärt wird), der bereinigte R² (der das Hinzufügen von Prädiktoren bestraft, die das Modell nicht wirklich verbessern), die F-Statistik (die testet, ob das Gesamtmodell statistisch signifikant ist) und den Standardfehler der Schätzung (der den durchschnittlichen Abstand der Datenpunkte von der Regressionshyperebene misst).

📊 Das Verständnis dieser Metriken ist für die Erstellung zuverlässiger Daten von entscheidender Bedeutung Modelle und Vermeidung einer Überanpassung, die auftritt, wenn im Verhältnis zur Stichprobengröße zu viele Prädiktoren einbezogen werden.