Ligne de régression des moindres carrés

Calculez instantanément la droite de régression des moindres carrés. Entrez vos données pour trouver l'équation linéaire la mieux ajustée OLS y = mx + b...

Ligne de régression des moindres carrés

Calculez instantanément la droite de régression des moindres carrés. Entrez vos données pour trouver l'équation linéaire la mieux ajustée OLS y = mx + b...

Entrez vos points de données

| # | X | Oui |

|---|

Results

Équation de régression

Pente (m)

Interception Y (b)

R² (Coefficient de Détermination)

Correlation (r)

Y prédit

Intermediate Calculations

| Symbol | Calculez instantanément la droite de régression des moindres carrés. Entrez vos données pour trouver l'équation linéaire la mieux ajustée OLS y = mx + b... | Value |

|---|

Statistics

| Statistic | Value |

|---|---|

| Standard Error | |

| Sample Size (n) | |

| Degrees of Freedom |

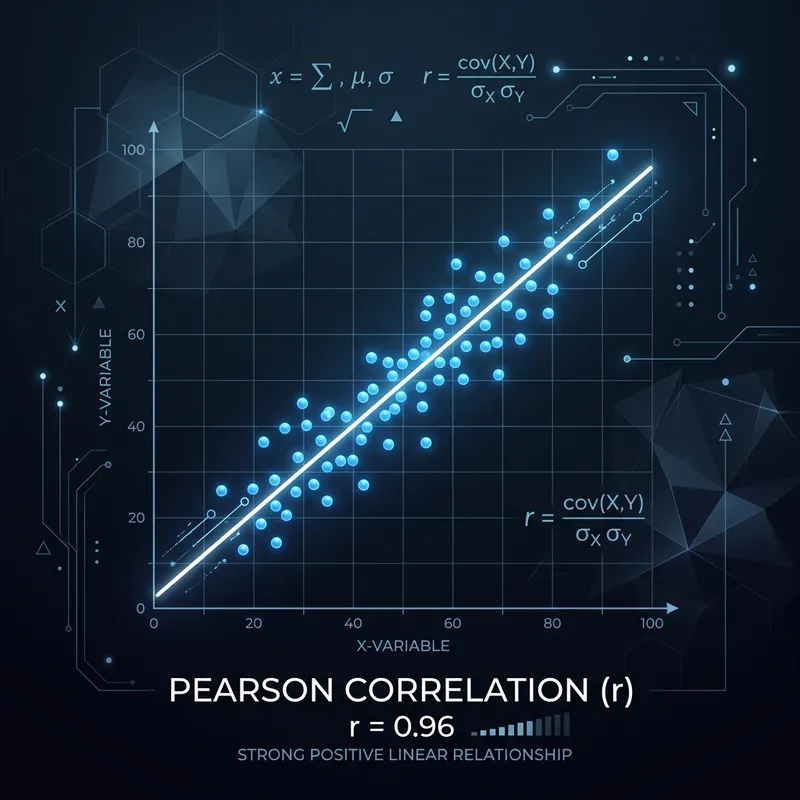

Chart

Solution étape par étape

Comment utiliser Ligne de régression des moindres carrés

Best Fit Line

Find the unique line that minimizes the total distance from all data points.

Résultats statistiques

Get the full equation y = a + bx, slope, intercept, and R-squared metrics.

Residual Analysis

Understand the deviation between observed values and model predictions.

The least squares method is the gold standard for linear regression in most scientific fields.

Qu'est-ce que la droite de régression des moindres carrés ?

📊 La droite de régression des moindres carrés (LSRL) est la ligne droite qui minimise la somme des carrés des distances verticales entre les points de données observés et la ligne. Mathématiquement, si nous avons n points de données (x₁, y₁), (x₂, y₂), …, (xₙ, yₙ), le LSRL est la droite ŷ = mx + b qui minimise la quantité Σ(yᵢ − ŷᵢ)², où ŷᵢ = mxᵢ + b sont les valeurs prédites. valeurs.

🏆 Ce critère est appelé le critère des moindres carrés, et la ligne résultante est également connue sous le nom de ligne des moindres carrés ordinaires (OLS) ou ligne de meilleur ajustement. La méthode des moindres carrés a une riche histoire qui remonte à Adrien-Marie Legendre en 1805, qui l'a publiée comme moyen de déterminer les orbites des comètes, et à Carl Friedrich Gauss, qui prétendait l'utiliser depuis 1795 et l'a ensuite développée plus tard dans sa théorie des erreurs.

⚠️ Le nom "moindres carrés" vient directement de l'objectif mathématique : parmi toutes les lignes possibles, nous choisissons celui qui rend la somme des carrés résiduels aussi petite que possible — la plus petite somme de carrés. La mise au carré des résidus (plutôt que de prendre des valeurs absolues) garantit que les erreurs positives et négatives ne s'annulent pas, et donne également plus de poids aux écarts plus importants, ce qui est statistiquement souhaitable.

📊 Aujourd'hui, la droite de régression des moindres carrés est la méthode la plus largement utilisée pour ajuster une ligne droite passant par des points de données dans les statistiques, l'économie, les sciences naturelles, les sciences sociales et l'ingénierie. Il sert de base à des techniques plus avancées, notamment la régression multiple, les modèles linéaires généralisés et les algorithmes d'apprentissage automatique. Chaque cours d'introduction aux statistiques enseigne le LSRL comme pierre angulaire de l'analyse de régression.

La méthode des moindres carrés

- 1 Calcule la ligne qui minimise la somme des carrés des résidus

- 2 Utilise les équations normales : Σ(y) = nb + mΣ(x) et Σ(xy) = bΣ(x) + mΣ(x²)

- 3 Résout la pente m = SSxy / SSxx et l'ordonnée à l'origine b = ȳ - m·x̄

- 4 Fournit R², l'erreur type et toutes les sommes intermédiaires

Quand utiliser la régression des moindres carrés

- Analyse des tendances linéaires en commerce et en économie

- Contrôle qualité et suivi des processus

- Courbes d'étalonnage en laboratoire

- Enseignement pédagogique des statistiques fondamentales

- Toute situation nécessitant la ligne droite la mieux adaptée

Hypothèses de régression des moindres carrés

- 1. Linéarité : La relation entre X et Y doit être linéaire. Vérifiez avec un nuage de points de Y par rapport à X et un tracé résiduel des valeurs résiduelles par rapport aux valeurs prédites. Un motif incurvé dans l’un ou l’autre des tracés indique une non-linéarité.

- 2. Indépendance : les résidus doivent être indépendants — pas d'autocorrélation. Vérifiez avec le test de Durbin-Watson (d ≈ 2 signifie pas d'autocorrélation). Les données de séries chronologiques violent souvent cette hypothèse.

- 3. Homoscédasticité : la variance résiduelle doit être constante sur toutes les valeurs prédites. Vérifiez avec un tracé résiduel (la propagation doit être à peu près égale) ou le test de Breusch-Pagan. Une forme d'entonnoir indique une hétéroscédasticité.

- 4. Normalité : Les résidus doivent être répartis à peu près normalement. Vérifiez avec un histogramme, un tracé de probabilité normale (tracé Q-Q) ou le test de Jarque-Bera. Les grands échantillons (n > 30) sont plus résistants aux violations.

- 5. Aucune valeur aberrante influente : une seule valeur aberrante extrême peut modifier considérablement la ligne de régression. Vérifiez avec la distance de Cook ou les valeurs de levier. Envisagez une régression robuste si les valeurs aberrantes ne peuvent pas être supprimées.

- 6. Échantillonnage représentatif : les données doivent constituer un échantillon représentatif de la population d'intérêt. Des échantillons de commodité ou des plages tronquées peuvent produire des résultats de régression trompeurs.