Calculateur de régression multiple

Calculez plusieurs équations de régression avec deux prédicteurs ou plus. Trouvez le meilleur modèle pour vos données à l’aide de notre outil d’analyse...

Calculateur de régression multiple

Calculez plusieurs équations de régression avec deux prédicteurs ou plus. Trouvez le meilleur modèle pour vos données à l’aide de notre outil d’analyse...

Entrez vos points de données

Résultats

R-carré

Adjusted R-Squared

Standard Error

Solution étape par étape

Comment utiliser Calculateur de régression multiple

Complex Modeling

Analyze how multiple factors simultaneously influence your dependent variable.

Résultats statistiques

Calculate partial coefficients, standard errors, and adjusted R-squared values.

Diagnostics

Built-in checks for multicollinearity and model significance.

Multiple regression helps isolate the effect of one variable while controlling for others.

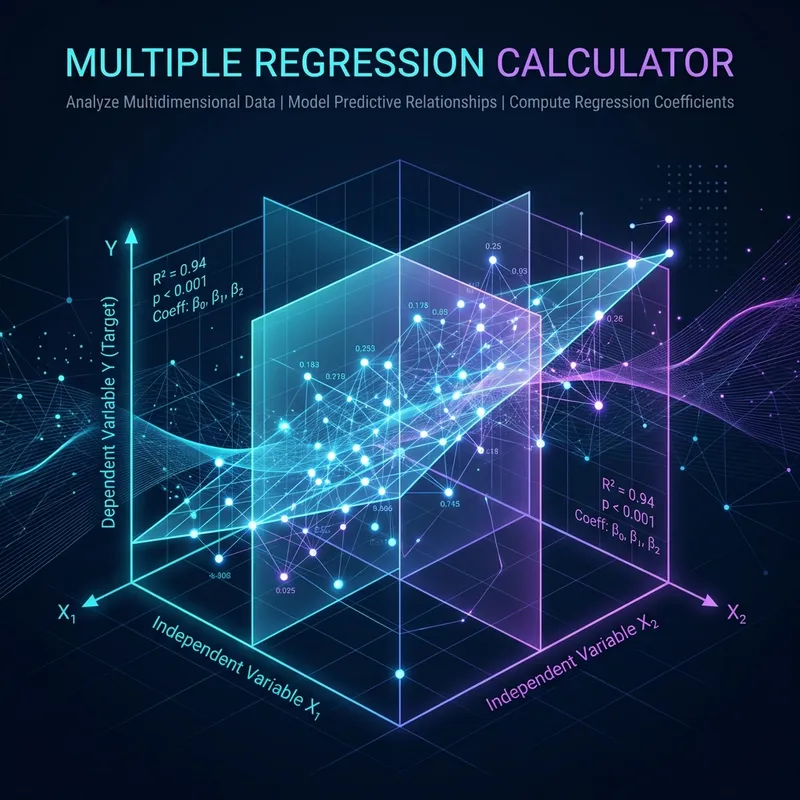

Comment calculer la régression multiple

📐 La régression multiple étend la régression linéaire simple à deux variables prédictives ou plus, produisant l'équation y = b₀ + b₁x₁ + b₂x₂ + … + bₚxₚ, où chaque coefficient bᵢ représente l'effet du prédicteur xᵢ sur y tout en maintenant tous les autres prédicteurs constants.

❌ Cette propriété de « maintien constant » est ce qui rend la régression multiple si puissante : elle vous permet d'isoler la contribution unique de chaque prédicteur, en contrôlant les facteurs de confusion qui autrement fausseraient vos résultats. Par exemple, si vous souhaitez étudier l'effet de l'éducation sur le revenu, une simple régression du revenu sur l'éducation confondrait l'effet de l'éducation avec l'effet de l'expérience, car les personnes plus instruites ont également tendance à avoir plus d'expérience.

📐 La régression multiple résout ce problème en incluant à la fois l'éducation et l'expérience comme prédicteurs, de sorte que chaque coefficient reflète le véritable effet de cette variable à elle seule. La régression multiple est la technique de régression la plus largement utilisée dans la recherche, l'analyse commerciale, les sciences sociales, la médecine et l'apprentissage automatique, car les résultats du monde réel dépendent presque toujours de plusieurs facteurs simultanément.

📊 Un modèle à prédicteur unique capture rarement suffisamment de variation pour être utile : l'ajout de prédicteurs pertinents augmente presque toujours le pouvoir explicatif et améliore la précision des prédictions. Les statistiques clés rapportées incluent le R² (la proportion de variance expliquée par tous les prédicteurs ensemble), le R² ajusté (qui pénalise l'ajout de prédicteurs qui n'améliorent pas réellement le modèle), la statistique F (qui teste si le modèle global est statistiquement significatif) et l'erreur standard de l'estimation (qui mesure la distance moyenne des points de données par rapport à l'hyperplan de régression).

📊 Comprendre ces métriques est essentiel pour construire des modèles fiables et éviter le surajustement, qui se produit lorsque trop de prédicteurs sont inclus par rapport à la taille de l'échantillon.