最小二乗回帰直線

最小二乗回帰直線を即座に計算します。 データを入力して、包括的な数学的ソリューションを使用して OLS の最適直線方程式 y = mx + b を見つけます。

データポイントを入力してください

| # | × | Y |

|---|

Results

回帰式

勾配(m)

Y 切片 (b)

R² (決定係数)

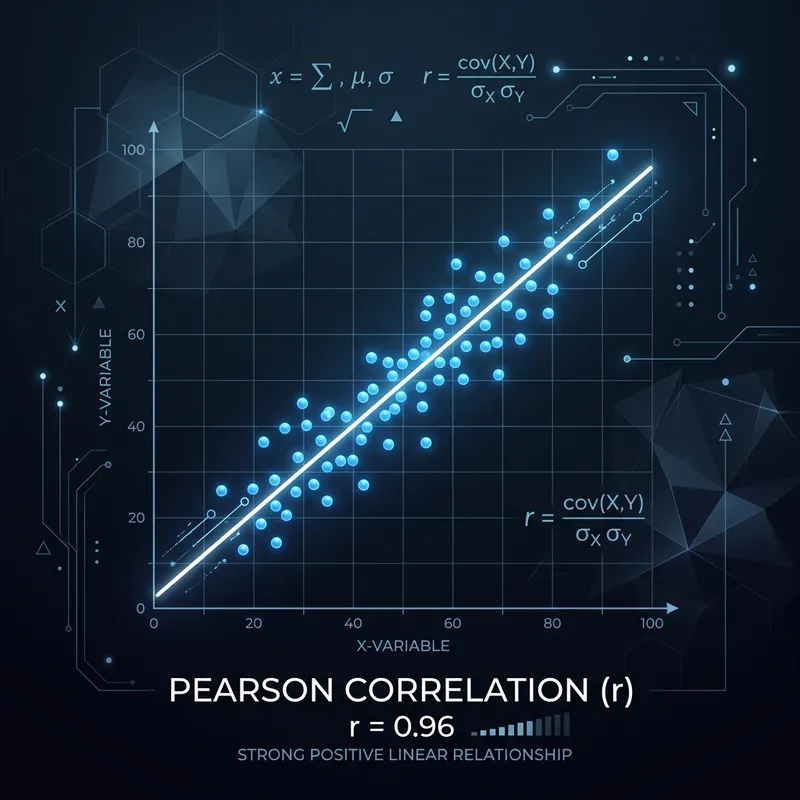

Correlation (r)

予測Y

Intermediate Calculations

| Symbol | 最小二乗回帰直線を即座に計算します。 データを入力して、包括的な数学的ソリューションを使用して OLS の最適直線方程式 y = mx + b を見つけます。 | Value |

|---|

Statistics

| Statistic | Value |

|---|---|

| Standard Error | |

| Sample Size (n) | |

| Degrees of Freedom |

Chart

段階的な解決策

使い方 最小二乗回帰直線

Best Fit Line

Find the unique line that minimizes the total distance from all data points.

統計出力

Get the full equation y = a + bx, slope, intercept, and R-squared metrics.

Residual Analysis

Understand the deviation between observed values and model predictions.

The least squares method is the gold standard for linear regression in most scientific fields.

最小二乗回帰直線とは何ですか?

📊 最小二乗回帰直線 (LSRL) は、観測されたデータ ポイントと直線の間の垂直距離の二乗の合計を最小化する直線です。 数学的には、n 個のデータ点 (x₁, y₁), (x₂, y₂), …, (xₙ, yₙ) がある場合、LSRL は量Σ(yᵢ − ŷᵢ)² を最小化する直線ŷ = mx + b です。ここで、 ŷᵢ = mxᵢ + b は次のとおりです。

🏆 この基準は最小二乗基準と呼ばれ、結果として得られる直線は、通常最小二乗 (OLS) 直線または最良適合直線とも呼ばれます。 最小二乗法には豊かな歴史があり、彗星の軌道を決定する方法としてこの法を発表した 1805 年のアドリアン・マリー・ルジャンドルや、1795 年から最小二乗法を使用し、後に誤差理論でさらに発展させたと主張したカール・フリードリッヒ・ ガウスにまで遡ります。

⚠️ 「最小二乗法」という名前は、次の数学的目的に直接由来しています。 考えられるすべての直線の中から、残差の二乗和をできるだけ小さくする直線、つまり二乗の最小和を選択します。 (絶対値を取得するのではなく) 残差を 2 乗すると、正と負の誤差が互いに打ち消し合わなくなり、より大きな偏差に重みがかかるため、統計的に望ましいことになります。

📊 現在、最小二乗回帰直線は、統計、経済学、自然科学、社会科学、工学において、データ ポイントを直線に近似するために最も広く使用されている方法です。 これは、重回帰、一般化線形モデル、機械学習アルゴリズムなどのより高度な技術の基盤として機能します。 すべての統計入門コースでは、回帰分析の基礎として LSRL を教えます。

最小二乗法

- 1 残差の二乗和を最小にする直線を計算します。

- 2 正規方程式を使用します: Σ(y) = nb + mΣ(x) および Σ(xy) = bΣ(x) + mΣ(x²)

- 3 傾き m = SSxy / SSxx と切片 b = ų - m·x̄ を解きます。

- 4 R²、標準誤差、およびすべての中間合計を提供します

最小二乗回帰を使用する場合

- ビジネスと経済における線形トレンド分析

- 品質管理とプロセス監視

- 実験室環境での検量線

- 基礎統計の教育教育

- 最適な直線が必要なあらゆる状況

最小二乗回帰の仮定

- 1. 線形性: X と Y の関係は線形である必要があります。 Y 対 X の散布図と残差対予測値の残差プロットで確認します。 どちらのプロットでも曲線パターンは非線形であることを示しています。

- 2. 独立性: 残差は独立している必要があります。自己相関はありません。 ダービン-ワトソン検定で確認してください (d ≈ 2 は自己相関がないことを意味します)。 時系列データは多くの場合、この前提に違反します。

- 3. 等分散性: 残差分散はすべての予測値にわたって一定である必要があります。 残差プロット (広がりはほぼ等しいはずです) または Breusch-Pagan 検定で確認してください。 漏斗状は不均一分散性を示します。

- 4. 正規性: 残差はほぼ正規分布する必要があります。 ヒストグラム、正規確率プロット (Q-Q プロット)、または Jarque-Bera 検定で確認します。 サンプルが大きい (n> 30) と、違反に対してより堅牢になります。

- 5.影響力のある外れ値がない: 1 つの極端な外れ値によって回帰直線が劇的に変化する可能性があります。 クックの距離またはレバレッジの値を確認してください。 外れ値を除去できない場合は、ロバスト回帰を検討してください。

- 6. 代表的なサンプリング: データは対象母集団の代表的なサンプルである必要があります。 便宜的なサンプルや切り捨てられた範囲では、誤解を招く回帰結果が生成される可能性があります。